AWS Integra GPUs NVIDIA Blackwell ao SageMaker com Novas Instâncias G7e

Amazon Web Services (AWS) introduziu a disponibilidade geral de suas AWS G7e instances na plataforma SageMaker AI. Estas instâncias, que se tornaram disponíveis esta semana, utilizam NVIDIA RTX PRO 6000 Blackwell Server Edition GPUs para acelerar a inferência de IA generativa. Ao incorporar este hardware avançado, a AWS oferece um ambiente de alto desempenho para implantar modelos complexos de machine learning em escala.

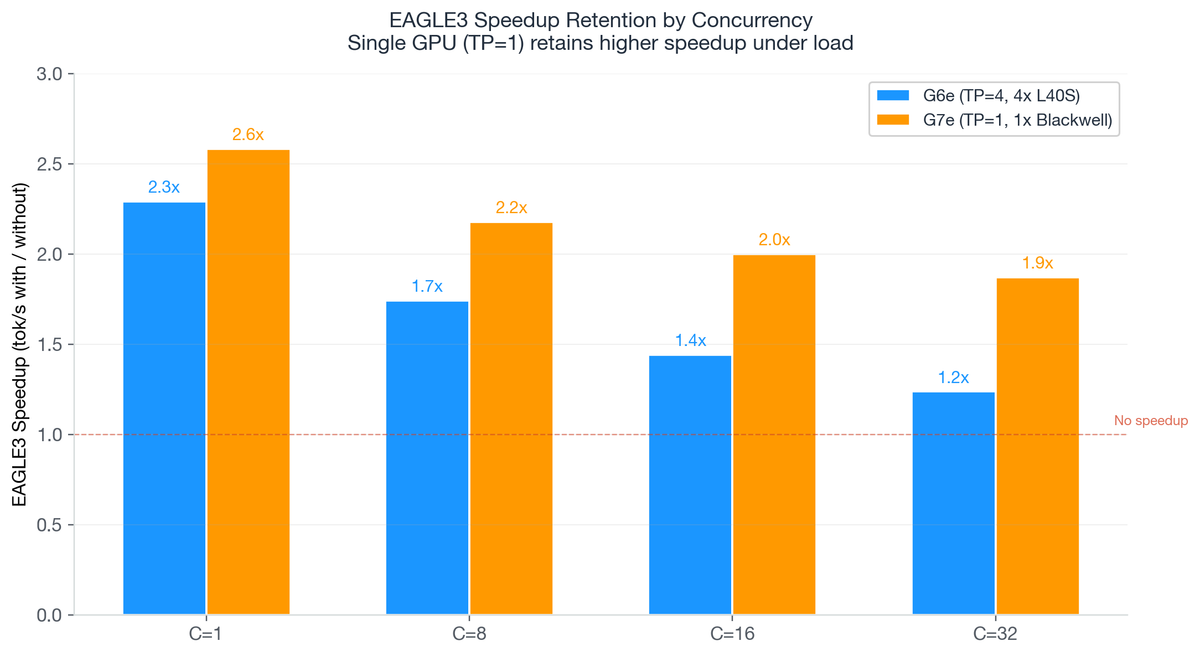

As especificações técnicas das AWS G7e instances oferecem um salto substancial em relação à geração G6e anterior. Cada GPU possui 96GB de memória GDDR7, efetivamente dobrando a capacidade de memória de sua antecessora. A AWS afirmou que essas melhorias entregam até 2,3x mais desempenho, permitindo um processamento mais eficiente de tarefas complexas de IA. Notavelmente, uma instância ml.g7e.2xlarge de nó único agora pode hospedar um modelo com 120 bilhões de parâmetros.

Vantagens Estratégicas das AWS G7e Instances

Para organizações que gerenciam modelos de fundação massivos, a escalabilidade do novo hardware é um fator crítico. A maior configuração, a variante ml.g7e.48xlarge de 8 GPUs, suporta modelos com até 300 bilhões de parâmetros. Isso permite que as empresas executem aplicações de IA altamente sofisticadas em um único cluster, reduzindo a complexidade arquitetônica frequentemente associada à inferência distribuída.

A integração das NVIDIA Blackwell GPUs no ecossistema SageMaker proporciona um caminho simplificado para a implantação. Ao oferecer estas AWS G7e instances, a empresa permite que desenvolvedores aproveitem o silício de alto desempenho sem sair de seus fluxos de trabalho de machine learning estabelecidos. Este movimento fortalece a posição competitiva da AWS no mercado de infraestrutura em nuvem, à medida que as empresas buscam formas mais econômicas de escalar soluções de IA generativa.

Embora busquemos a precisão, o bytevyte pode cometer erros. Os usuários são aconselhados a verificar todas as informações de forma independente. Não aceitamos qualquer responsabilidade por erros ou omissões.

Related Articles

- AWS reduz custos de IA com Nova model distillation

- AWS e NEURA firmam parceria para o cognitive robotics deployment

- Intel e Google Cloud impulsionam desempenho de AI com Xeon 6 e silício personalizado

✔Human Verified