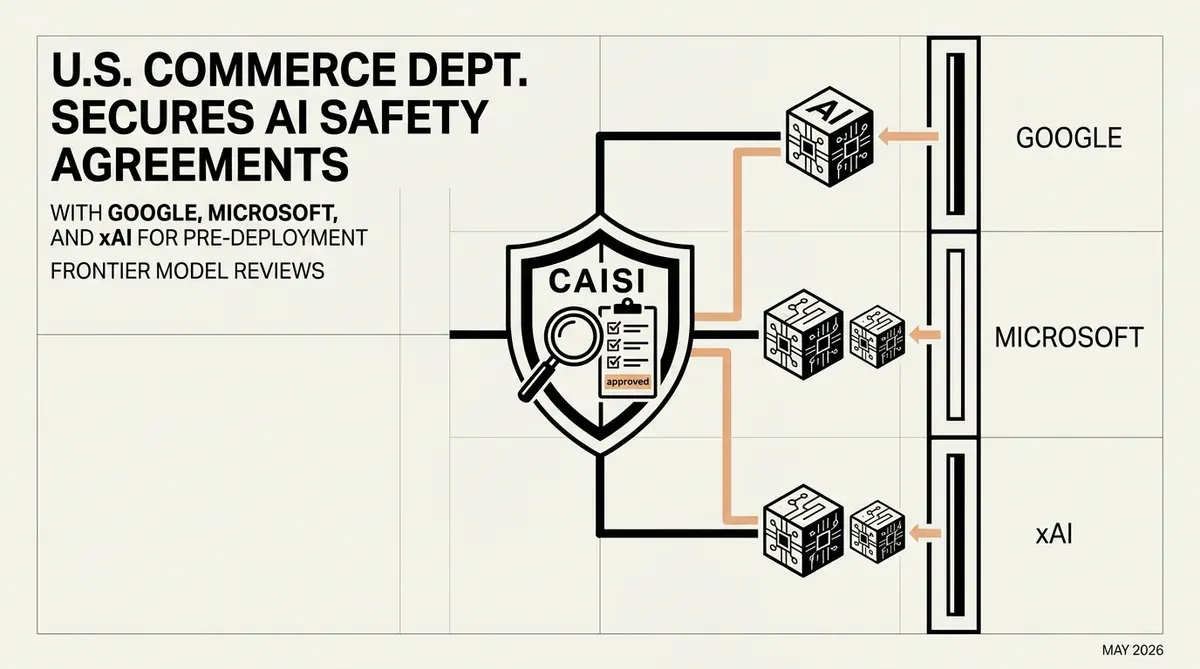

Departamento de Comércio dos EUA firma acordos de segurança de IA com Google, Microsoft e xAI

O U.S. Department of Commerce expandiu sua supervisão sobre a inteligência artificial ao garantir AI safety agreements voluntários com Google DeepMind, Microsoft e xAI. Anunciados em 5 de maio de 2026, esses pactos concedem ao Center for AI Standards and Innovation (CAISI) acesso antecipado a modelos de fronteira antes de seu lançamento público. Esse movimento permite que especialistas federais realizem revisões rigorosas de segurança nacional e avaliações baseadas em risco nos sistemas mais avançados atualmente em desenvolvimento.

Sob os termos desses acordos, o CAISI avaliará os próximos modelos de IA em busca de vulnerabilidades específicas de alto risco. O foco principal dessas avaliações inclui a identificação de riscos relacionados à cybersecurity, biosecurity e ao potencial mau uso da IA no desenvolvimento de chemical weapons. Ao formalizar essas parcerias, o governo dos EUA visa estabelecer uma estrutura padronizada para testar os limites de segurança da tecnologia generativa antes que ela chegue ao mercado comercial.

Implicações Estratégicas dos Novos Acordos de Segurança de IA

A inclusão de Google DeepMind, Microsoft e xAI é uma expansão significativa da iniciativa de segurança de IA dos EUA. Essas empresas agora se juntam à OpenAI e Anthropic, que já haviam se alinhado anteriormente às diretrizes do CAISI. Para líderes empresariais e estrategistas, essa frente unificada sugere que os testes de pré-implantação estão se tornando um requisito padrão para qualquer organização que desenvolva modelos de fundação em larga escala. A participação da xAI é particularmente notável, pois indica que até mesmo os novos entrantes no mercado estão sendo integrados ao ecossistema de segurança federal.

A transição da organização de U.S. AI Safety Institute para CAISI reflete um compromisso institucional mais amplo com a governança de IA a longo prazo. Esta agência tem a tarefa de criar os benchmarks técnicos que provavelmente definirão a conformidade regulatória futura. Para CTOs e fundadores, a lição imediata é que a barreira para o status de "fronteira" agora inclui um período obrigatório de escrutínio federal. Isso pode impactar os cronogramas de desenvolvimento, já que as empresas devem considerar o tempo necessário para que o CAISI conclua suas avaliações de segurança nacional.

Esta abordagem colaborativa busca equilibrar a inovação com a segurança pública sem recorrer a uma legislação rígida imediata. Ao confiar em AI safety agreements voluntários, o Departamento de Comércio mantém um relacionamento flexível com o setor privado, ao mesmo tempo em que obtém uma visão técnica profunda sobre as capacidades dos modelos de próxima geração. Até maio de 2026, o foco permanece na prevenção do mau uso catastrófico, mas os dados coletados durante essas revisões certamente informarão a próxima fase da política global de IA e dos padrões de segurança.

Embora busquemos a precisão, o bytevyte pode cometer erros. Os usuários são aconselhados a verificar todas as informações de forma independente. Não aceitamos responsabilidade por erros ou omissões.

Related Articles

- SAP e Agência Alemã de Cibersegurança Lançam Estrutura Colaborativa para Sovereign AI Cloud

- Google Expands Defense Partnership as Gemini AI Enters Classified Pentagon Networks

- Riscos de segurança do Claude Mythos provocam Cúpula Federal de IA

✔Human Verified