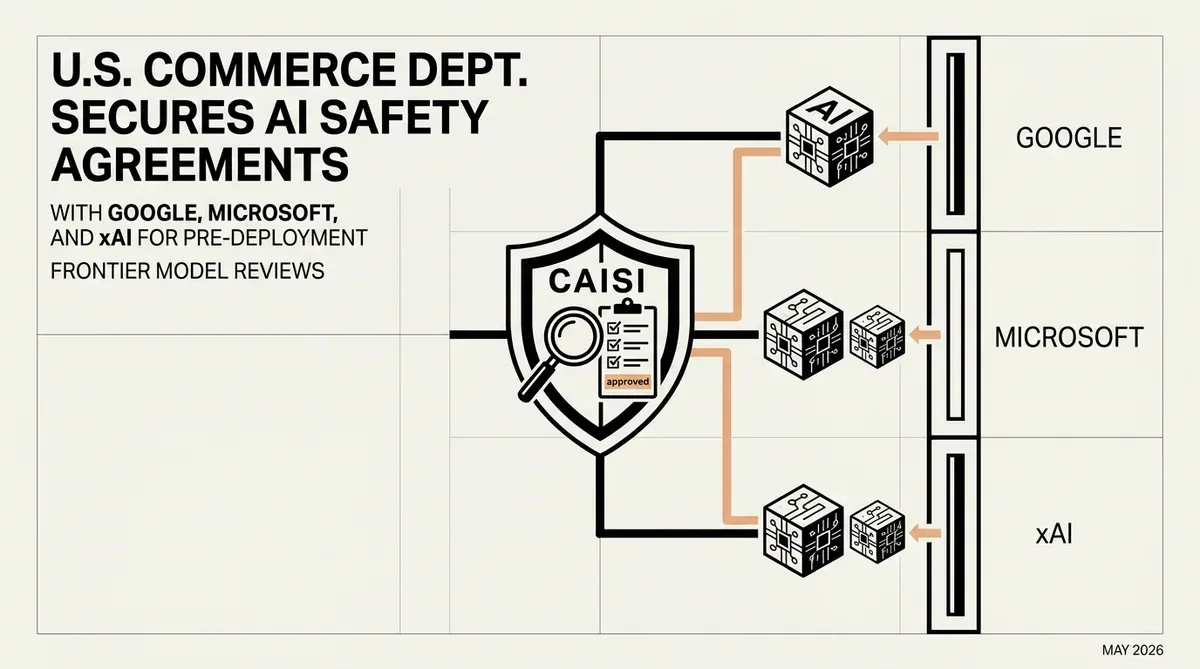

El Departamento de Comercio de EE. UU. asegura acuerdos de seguridad de IA con Google, Microsoft y xAI

El U.S. Department of Commerce ha ampliado su supervisión de la inteligencia artificial al asegurar acuerdos de seguridad de IA voluntarios con Google DeepMind, Microsoft y xAI. Anunciados el 5 de mayo de 2026, estos pactos otorgan al Center for AI Standards and Innovation (CAISI) acceso anticipado a modelos de frontera antes de su lanzamiento público. Este movimiento permite a los expertos federales realizar revisiones rigurosas de seguridad nacional y evaluaciones basadas en riesgos sobre los sistemas más avanzados actualmente en desarrollo.

Bajo los términos de estos acuerdos, el CAISI evaluará los próximos modelos de IA en busca de vulnerabilidades específicas de alto riesgo. El enfoque principal de estas evaluaciones incluye la identificación de riesgos relacionados con la cybersecurity, la biosecurity y el posible uso indebido de la IA en el desarrollo de chemical weapons. Al formalizar estas asociaciones, el gobierno de EE. UU. pretende establecer un marco estandarizado para probar los límites de seguridad de la tecnología generativa antes de que llegue al mercado comercial.

Implicaciones estratégicas de los nuevos acuerdos de seguridad de IA

La inclusión de Google DeepMind, Microsoft y xAI supone una expansión significativa de la iniciativa de seguridad de IA de EE. UU. Estas empresas se unen ahora a OpenAI y Anthropic, que ya se habían alineado previamente con las directivas del CAISI. Para los líderes y estrategas empresariales, este frente unido sugiere que las pruebas previas al despliegue se están convirtiendo en un requisito estándar para cualquier organización que desarrolle modelos fundacionales a gran escala. La participación de xAI es particularmente notable, ya que indica que incluso los nuevos participantes del mercado se están integrando en el marco de seguridad federal.

La transición de la organización del U.S. AI Safety Institute al CAISI refleja un compromiso institucional más amplio con la gobernanza de la IA a largo plazo. Esta agencia tiene la tarea de crear los puntos de referencia técnicos que probablemente definirán el cumplimiento normativo futuro. Para los CTO y fundadores, la conclusión inmediata es que la barrera para el estatus de "frontera" ahora incluye un período obligatorio de escrutinio federal. Esto podría afectar los cronogramas de desarrollo, ya que las empresas deben considerar el tiempo necesario para que el CAISI complete sus evaluaciones de seguridad nacional.

Este enfoque colaborativo busca equilibrar la innovación con la seguridad pública sin recurrir a una legislación rígida inmediata. Al confiar en acuerdos de seguridad de IA voluntarios, el Departamento de Comercio mantiene una relación flexible con el sector privado mientras obtiene una visión técnica profunda de las capacidades de los modelos de próxima generación. A partir de mayo de 2026, el enfoque sigue siendo prevenir el uso indebido catastrófico, pero los datos recopilados durante estas revisiones casi con seguridad informarán la próxima fase de la política global de IA y los estándares de seguridad.

Aunque nos esforzamos por la exactitud, bytevyte puede cometer errores. Se aconseja a los usuarios verificar toda la información de forma independiente. No aceptamos ninguna responsabilidad por errores u omisiones.

Related Articles

- Microsoft lanza MAI-Image-2-Efficient para reducir costos de IA

- SAP y la Agencia Alemana de Ciberseguridad lanzan un marco de colaboración para la Sovereign AI Cloud

- El Departamento de Defensa de EE. UU. se asocia con gigantes tecnológicos para establecer una fuerza militar centrada en la IA

✔Human Verified