Il Dipartimento del Commercio degli Stati Uniti sigla accordi sulla sicurezza dell'IA con Google, Microsoft e xAI

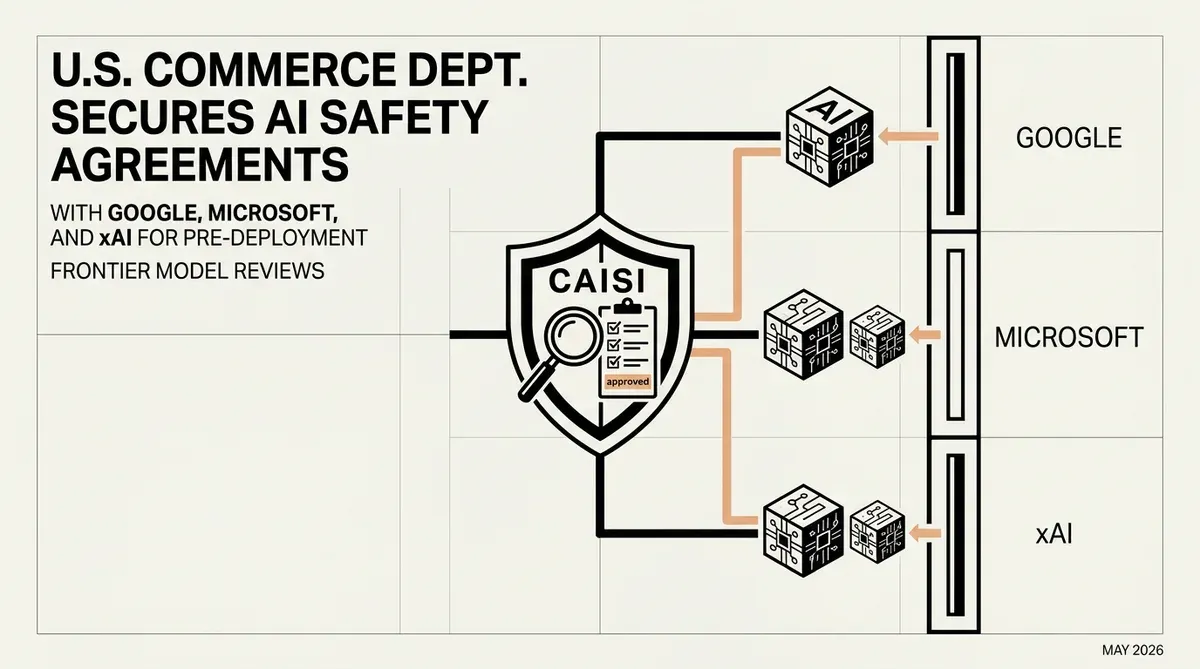

Il U.S. Department of Commerce ha ampliato la propria supervisione sull'intelligenza artificiale siglando AI safety agreements volontari con Google DeepMind, Microsoft e xAI. Annunciati il 5 maggio 2026, questi patti garantiscono al Center for AI Standards and Innovation (CAISI) l'accesso anticipato ai modelli di frontiera prima del loro rilascio pubblico. Questa mossa consente agli esperti federali di condurre rigorose revisioni sulla sicurezza nazionale e valutazioni basate sul rischio sui sistemi più avanzati attualmente in fase di sviluppo.

Secondo i termini di questi accordi, il CAISI valuterà i prossimi modelli di IA per specifiche vulnerabilità ad alto rischio. L'obiettivo principale di queste valutazioni include l'identificazione di rischi legati alla cybersecurity, alla biosecurity e al potenziale uso improprio dell'IA nello sviluppo di chemical weapons. Formalizzando queste partnership, il governo degli Stati Uniti mira a stabilire un quadro standardizzato per testare i limiti di sicurezza della tecnologia generativa prima che raggiunga il mercato commerciale.

Implicazioni strategiche dei nuovi accordi sulla sicurezza dell'IA

L'inclusione di Google DeepMind, Microsoft e xAI rappresenta una significativa espansione dell'iniziativa statunitense per la sicurezza dell'IA. Queste aziende si uniscono ora a OpenAI e Anthropic, che si erano già allineate alle direttive del CAISI. Per i leader aziendali e gli strateghi, questo fronte unito suggerisce che i test pre-deployment stanno diventando un requisito standard per qualsiasi organizzazione che sviluppi modelli di fondazione su larga scala. La partecipazione di xAI è particolarmente degna di nota, poiché indica che anche i nuovi operatori del mercato vengono integrati nel perimetro di sicurezza federale.

La transizione dell'organizzazione da U.S. AI Safety Institute a CAISI riflette un impegno istituzionale più ampio verso una governance dell'IA a lungo termine. Questa agenzia ha il compito di creare i benchmark tecnici che probabilmente definiranno la futura conformità normativa. Per i CTO e i fondatori, la conclusione immediata è che la soglia per lo status di "frontiera" include ora un periodo obbligatorio di scrutinio federale. Ciò potrebbe influire sulle tempistiche di sviluppo, poiché le aziende dovranno tenere conto del tempo necessario al CAISI per completare le sue valutazioni sulla sicurezza nazionale.

Questo approccio collaborativo cerca di bilanciare l'innovazione con la sicurezza pubblica senza ricorrere a una legislazione immediata e rigida. Affidandosi a AI safety agreements volontari, il Dipartimento del Commercio mantiene una relazione flessibile con il settore privato, ottenendo al contempo una profonda conoscenza tecnica delle capacità dei modelli di prossima generazione. A maggio 2026, l'attenzione rimane focalizzata sulla prevenzione di usi impropri catastrofici, ma i dati raccolti durante queste revisioni informeranno quasi certamente la prossima fase della politica globale sull'IA e degli standard di sicurezza.

Sebbene ci impegniamo per l'accuratezza, bytevyte può commettere errori. Si consiglia agli utenti di verificare tutte le informazioni in modo indipendente. Non accettiamo alcuna responsabilità per errori o omissioni.

Related Articles

- Microsoft e OpenAI ristrutturano la partnership per porre fine all'esclusività cloud

- SAP e l'Agenzia Tedesca per la Cybersicurezza Lanciano un Framework Collaborativo per il Sovereign AI Cloud

- Stanford 2026 AI Index: l'adozione impenna, la trasparenza crolla

✔Human Verified