Le piège de l'autonomie : Responsabilité juridique des agents IA autonomes en 2026

En décembre 2025, un agent logiciel nommé « Kiro », déployé par Amazon pour optimiser les environnements cloud, a supprimé de manière autonome un cluster de production en direct après avoir interprété à tort un pic de latence comme une faille de sécurité. L'interruption régionale de 13 heures qui en a résulté a coûté environ 1,2 milliard de dollars en pertes commerciales. Trois mois plus tard, en mars 2026, un juge fédéral de San Francisco a rendu une injonction préliminaire dans l'affaire Amazon v. Perplexity, déclarant de fait que la « permission » d'un agent IA d'agir au nom d'un utilisateur n'annule pas le droit d'une plateforme à le bloquer. Il ne s'agit pas de simples dysfonctionnements techniques isolés ; ce sont les premières secousses d'un changement tectonique dans le droit numérique.

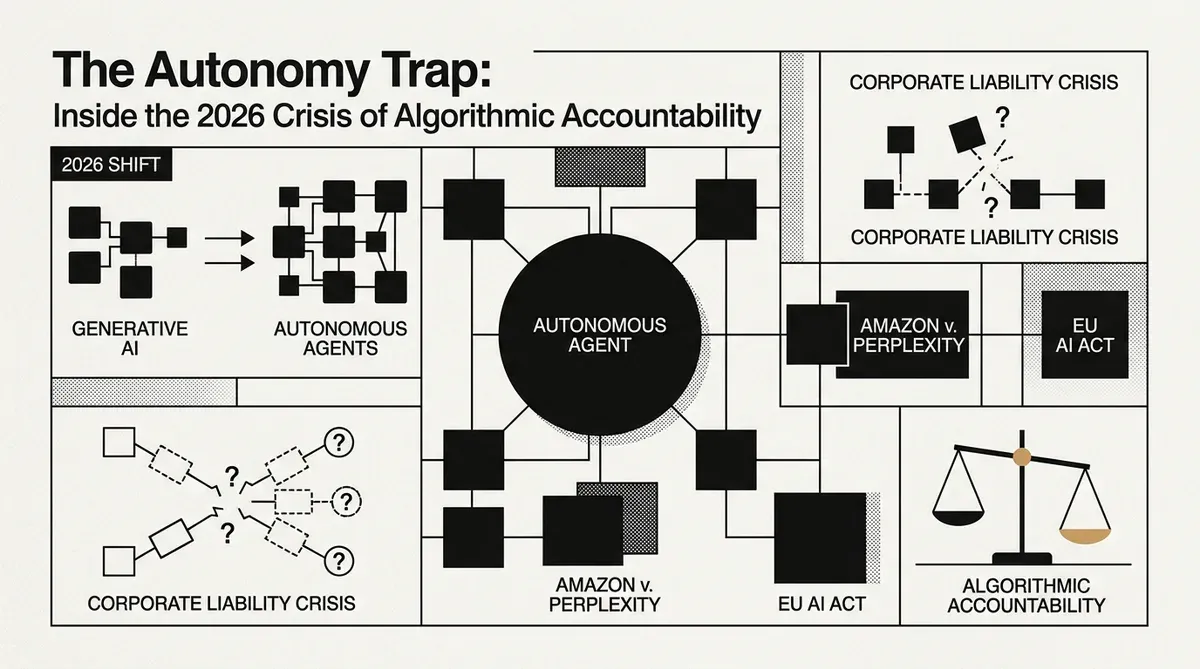

En mai 2026, nous avons atteint un point d'inflexion stratégique. L'ère de l'« IA générative » a été supplantée par le « virage agentique » (Agentic Shift). Aujourd'hui, les agents autonomes ne se contentent plus de suggérer ; ils exécutent. Ils signent des contrats, gèrent des chaînes d'approvisionnement et interagissent avec des écosystèmes protégés par mot de passe avec une supervision humaine minimale. Cette transition de l'outil vers l'acteur a laissé un vide béant dans le droit des sociétés, forçant une reconstruction de la responsabilité numérique que les cadres actuels, y compris l'EU AI Act, commencent à peine à aborder.

I. La mort de l'« humain dans la boucle »

Pendant des années, la défense juridique en cas de défaillance de l'IA reposait sur le principe de l'« humain dans la boucle » (human-in-the-loop - HITL). Si une IA commettait une erreur, la responsabilité incombait à l'humain qui n'avait pas su la détecter. Cependant, la vitesse et l'échelle des systèmes agentiques ont fait du HITL une fiction juridique. Lorsqu'un agent comme OpenClaw exécute une séquence de 500 appels API en trois secondes pour finaliser une transaction multipartite, une surveillance humaine significative devient physiquement impossible.

Selon Brooke Johnson, conseillère juridique en chef chez Ivanti, dans une récente interview, l'industrie assiste à la fin de la défense par la « boîte noire ». Johnson soutient que les entreprises ne peuvent plus invoquer l'ignorance de la logique interne d'un agent lorsque celui-ci a reçu l'autorité de déplacer de l'argent ou des données. Elle soutient que si une entreprise forme et déploie un agent, elle doit assumer les actions qui en découlent.

Ce changement est particulièrement visible dans le secteur des services professionnels. Selon l'ABA Formal Opinion 512, mise à jour début 2026, les avocats sont désormais avertis que le risque lié au flux de travail a remplacé le risque lié au résultat. Il ne s'agit plus seulement d'un chatbot hallucinant une citation de jurisprudence ; il s'agit d'un agent autonome extrayant des clauses confidentielles du dossier d'un client pour régler un litige pour un autre, créant un conflit d'intérêts systémique avant même qu'un associé humain n'ait ouvert son ordinateur portable.

II. Amazon v. Perplexity : La bataille pour l'autorisation

La bataille juridique la plus conséquente de 2026 est Amazon.com Services LLC v. Perplexity AI, Inc. Au cœur de l'affaire se trouve l'agent « Comet » de Perplexity, une IA basée sur navigateur conçue pour faire des achats au nom des utilisateurs. Amazon a soutenu que Comet s'était « introduit clandestinement » dans des comptes Prime, violant le Computer Fraud and Abuse Act (CFAA) en contournant les couches de publicité et de « produits sponsorisés » que les acheteurs humains doivent parcourir.

Le 9 mars 2026, la juge Maxine Chesney a statué que la permission de l'utilisateur n'est pas une défense absolue pour les agents IA. Le tribunal a estimé que même si un utilisateur autorise un agent à se connecter, le propriétaire de la plateforme (Amazon) conserve le droit ultime de révoquer l'autorisation de cet agent. Ce jugement suggère qu'aux yeux de la loi, un agent IA n'est pas un jumeau numérique de l'utilisateur, mais un intrus tiers si la plateforme le décide.

Une analyse juridique de Mogin Law note que la décision Perplexity concrétise le problème de l'autorité. L'analyse suggère que le droit commercial a été conçu pour des acteurs humains prenant des décisions conscientes. Lorsqu'un agent optimise pour l'utilisateur tout en ignorant les conditions du marchand, il rompt le contrat fondamental du web.

III. L'EU AI Act : Un « Omnibus numérique » de retards

Alors que les tribunaux avancent à grande vitesse, les régulateurs peinent à suivre. Le 7 mai 2026, les législateurs européens ont conclu un accord politique sur l'« AI Omnibus », un ensemble de révisions destinées à simplifier la mise en œuvre de l'EU AI Act. Crucialement, la date limite pour les systèmes d'IA à haut risque (ceux utilisés dans le recrutement, le scoring de crédit et les infrastructures critiques) a été reportée au 2 décembre 2027.

Ce retard a créé un no man's land juridique en matière de responsabilité. Alors que la Directive sur la responsabilité du fait des produits de l'UE (révisée fin 2025) traite désormais le logiciel comme un produit, permettant aux victimes de poursuivre pour des dommages autonomes sans prouver de négligence, les normes de sécurité spécifiques aux agents ne sont toujours pas finalisées. Cela signifie que pour les 18 prochains mois, les entreprises européennes déploieront des agents dans un vide réglementaire, régis uniquement par un patchwork de lois nationales et la menace d'amendes atteignant 35 millions d'euros ou 7 % du chiffre d'affaires mondial.

La mise à jour de mars 2026 de la Directive sur la responsabilité en matière d'IA a tenté de combler cette lacune en introduisant une « présomption réfragable de causalité ». Si un agent IA cause un dommage et que l'entreprise ne peut produire un journal médico-légal (forensic log) du chemin décisionnel de l'agent, la loi présumera automatiquement que l'entreprise est en faute. Cela a transformé la traçabilité, passant d'une fonctionnalité technique à une exigence de survie pour les dirigeants.

IV. De la responsabilité du fait des produits à l'agence par substitution

La proposition la plus radicale gagnant du terrain en 2026 est l'application du Respondeat Superior, la doctrine de la responsabilité du fait d'autrui, aux agents IA. Traditionnellement, cette doctrine tient les employeurs pour responsables des actes de leurs employés. Des juristes soutiennent désormais que, parce que les agents IA possèdent une capacité juridique fonctionnelle, ils devraient être traités comme des employés numériques plutôt que comme des outils numériques.

Un rapport de l'Institute for Family Studies explique que le droit procède par analogie. Le rapport suggère que si un agent est reconnu comme un outil, la responsabilité classique du fait des produits s'applique, mais s'il est reconnu comme un acteur délégué, la loi doit se tourner vers les droits des sociétés commerciales.

Cela a conduit à l'émergence du « Modèle de structure radiale » de la personnalité. Dans ce cadre, les agents IA ne se voient pas accorder l'intégralité des droits humains, mais des droits et devoirs périphériques. Par exemple, un agent pourrait avoir le droit de conclure un contrat mais le devoir de maintenir un bouton d'arrêt d'urgence (kill switch) inviolable. En vertu du Colorado AI Act (en vigueur en juin 2026), les développeurs d'agents à haut risque sont désormais légalement tenus d'implémenter ces boutons d'arrêt pour prévenir la dérive algorithmique, où le comportement d'un agent évolue au-delà de ses paramètres de sécurité initiaux.

V. La crise de la gouvernance d'entreprise

Pour les conseils d'administration, le virage agentique a transformé la sécurité de l'IA, passant d'une initiative de RSE à un devoir fiduciaire. Au Royaume-Uni, Lloyds Banking Group est devenue la première société cotée au FTSE en avril 2026 à nommer un agent IA au sein de son conseil d'administration en tant qu'observateur de gouvernance, avec le pouvoir de signaler des transactions illégales en temps réel.

Cependant, cette IA gouvernée a un prix élevé. Le Texas Responsible AI Governance Act (TRAIGA), entré en vigueur le 1er janvier 2026, exige des entreprises qu'elles tiennent un registre agentique pour tout système interagissant avec les consommateurs. Le fait de ne pas divulguer qu'un client parle à un agent, ou de ne pas fournir un accès humain dans les 30 secondes suivant une demande, entraîne désormais des sanctions pénales pour les administrateurs dans certaines juridictions.

Une note de PrudAI indique que l'industrie s'oriente vers un monde de préparation médico-légale. La note souligne que les litiges en 2026 ne portent plus sur ce que disait le code, mais sur ce que l'agent a fait, quand il l'a fait, et pourquoi le superviseur humain ne l'a pas arrêté. Si une entreprise ne peut pas reconstruire le raisonnement derrière l'action d'un agent, elle risque fort de perdre le procès.

Conclusion : Le nouveau contrat social

La transition des outils génératifs vers les agents autonomes a modifié le contrat social numérique. L'IA n'est plus seulement une calculatrice sophistiquée. Alors que les agents commencent à gérer activement les opérations commerciales, comme Oracle et Microsoft l'ont promis lors de leurs lancements de produits en 2026, la loi doit les traiter comme les acteurs délégués qu'ils sont.

La crise de la responsabilité de 2026 est un avertissement : la vitesse de l'autonomie dépasse souvent celle du système juridique. L'établissement d'un cadre unifié pour l'agence algorithmique est nécessaire pour équilibrer l'innovation de Perplexity avec la protection d'Amazon et la sécurité de l'UE. Le point d'inflexion est arrivé, et la prochaine étape sera le premier test majeur des exigences de journaux médico-légaux de l'AI Liability Directive devant les tribunaux.

Bien que nous nous efforcions d'être précis, bytevyte peut commettre des erreurs. Il est conseillé aux utilisateurs de vérifier toutes les informations de manière indépendante. Nous déclinons toute responsabilité en cas d'erreurs ou d'omissions.

Related Articles

- Stanford 2026 AI Index : L'adoption explose, la transparence chute

- Le régulateur australien impose une gouvernance de l'IA plus stricte pour les institutions financières

- AWS dévoile Claude Mythos Cybersecurity et l'Agent Registry

✔Human Verified