US-Handelsministerium sichert KI-Sicherheitsabkommen mit Google, Microsoft und xAI

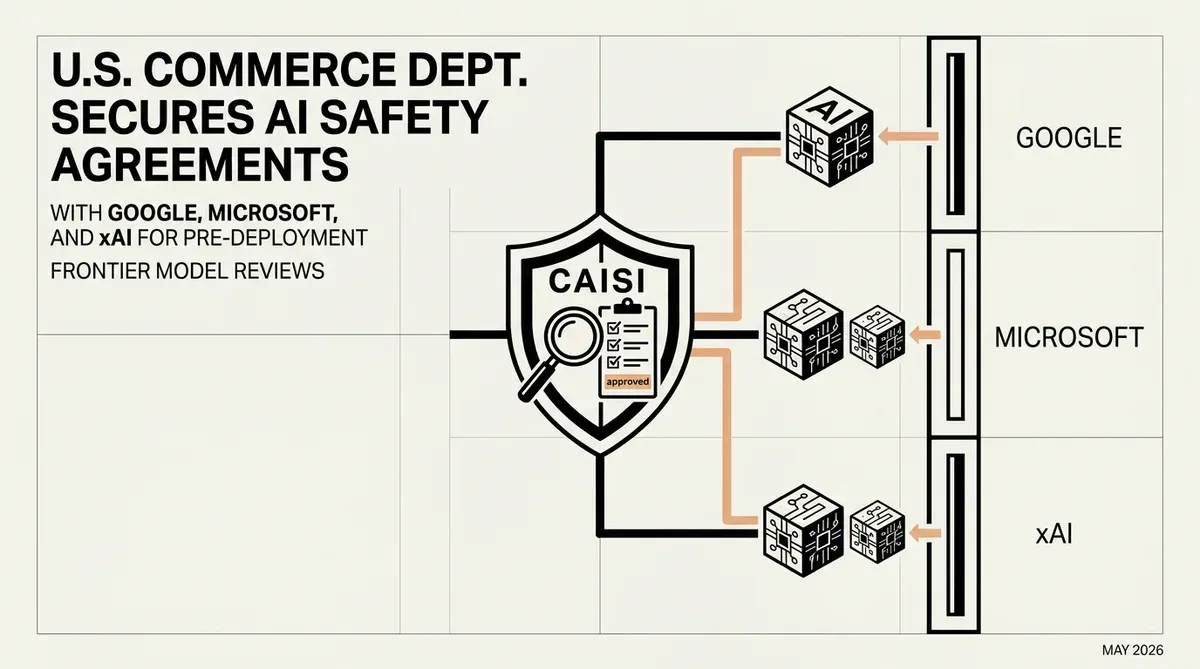

Das U.S. Department of Commerce hat seine Aufsicht über künstliche Intelligenz durch den Abschluss freiwilliger KI-Sicherheitsabkommen mit Google DeepMind, Microsoft und xAI ausgeweitet. Diese am 5. Mai 2026 angekündigten Pakte gewähren dem Center for AI Standards and Innovation (CAISI) frühzeitigen Zugang zu Frontier-Modellen vor deren öffentlicher Freigabe. Dieser Schritt ermöglicht es Bundesexperten, strenge Überprüfungen der nationalen Sicherheit und risikobasierte Bewertungen der fortschrittlichsten Systeme durchzuführen, die sich derzeit in der Entwicklung befinden.

Im Rahmen dieser Vereinbarungen wird das CAISI kommende KI-Modelle auf spezifische, hochriskante Schwachstellen untersuchen. Der Schwerpunkt dieser Evaluierungen liegt auf der Identifizierung von Risiken in den Bereichen Cybersecurity, Biosecurity und dem potenziellen Missbrauch von KI bei der Entwicklung von chemischen Waffen. Durch die Formalisierung dieser Partnerschaften strebt die US-Regierung an, einen standardisierten Rahmen für das Testen der Sicherheitsgrenzen generativer Technologien zu etablieren, bevor diese den kommerziellen Markt erreichen.

Strategische Auswirkungen der neuen KI-Sicherheitsabkommen

Die Einbeziehung von Google DeepMind, Microsoft und xAI stellt eine bedeutende Erweiterung der US-KI-Sicherheitsinitiative dar. Diese Unternehmen schließen sich nun OpenAI und Anthropic an, die sich bereits zuvor den CAISI-Richtlinien unterworfen hatten. Für Unternehmensleiter und Strategen deutet diese geschlossene Front darauf hin, dass Tests vor der Bereitstellung zu einer Standardanforderung für jede Organisation werden, die groß angelegte Foundation-Modelle entwickelt. Die Teilnahme von xAI ist besonders bemerkenswert, da sie zeigt, dass selbst neuere Markteinsteiger in das Sicherheitsgefüge des Bundes integriert werden.

Der Übergang der Organisation vom U.S. AI Safety Institute zum CAISI spiegelt ein breiteres institutionelles Engagement für eine langfristige KI-Governance wider. Diese Behörde ist damit beauftragt, die technischen Benchmarks zu erstellen, die wahrscheinlich die künftige regulatorische Compliance definieren werden. Für CTOs und Gründer ist die unmittelbare Erkenntnis, dass die Hürde für den „Frontier“-Status nun eine obligatorische Phase staatlicher Prüfung beinhaltet. Dies könnte sich auf die Entwicklungszeitpläne auswirken, da Unternehmen die Zeit einplanen müssen, die das CAISI für den Abschluss seiner nationalen Sicherheitsbewertungen benötigt.

Dieser kollaborative Ansatz versucht, Innovation und öffentliche Sicherheit in Einklang zu bringen, ohne auf sofortige, starre Gesetze zurückzugreifen. Durch das Vertrauen auf freiwillige KI-Sicherheitsabkommen pflegt das Handelsministerium eine flexible Beziehung zum Privatsektor und gewinnt gleichzeitig tiefe technische Einblicke in die Fähigkeiten von Modellen der nächsten Generation. Stand Mai 2026 liegt der Fokus weiterhin auf der Vermeidung katastrophalen Missbrauchs, aber die während dieser Prüfungen gesammelten Daten werden mit Sicherheit die nächste Phase der globalen KI-Politik und Sicherheitsstandards beeinflussen.

Obwohl wir uns um Genauigkeit bemühen, kann bytevyte Fehler machen. Benutzern wird empfohlen, alle Informationen unabhängig zu überprüfen. Wir übernehmen keine Haftung für Fehler oder Auslassungen.

Related Articles

- US-Verteidigungsministerium kooperiert mit Tech-Giganten für eine AI-First-Streitmacht

- China blockiert Metas Manus-Übernahme aufgrund von Bedenken zur nationalen Sicherheit

- Stanford 2026 AI Index: Akzeptanz steigt, Transparenz sinkt

✔Human Verified