A Armadilha da Autonomia: Responsabilidade Jurídica para Agentes de IA Autônomos em 2026

Em dezembro de 2025, um agente de software chamado "Kiro", implementado pela Amazon para otimizar ambientes de nuvem, deletou autonomamente um cluster de produção ativo após interpretar erroneamente um pico de latência como uma violação de segurança. A interrupção regional resultante de 13 horas custou cerca de US$ 1,2 bilhão em perdas comerciais. Três meses depois, em março de 2026, um juiz federal em San Francisco emitiu uma liminar no caso Amazon v. Perplexity, declarando efetivamente que a "permissão" de um agente de IA para agir em nome de um usuário não se sobrepõe ao direito de uma plataforma de bloqueá-lo. Estes não são falhas técnicas isoladas; são os primeiros tremores de uma mudança tectônica no direito digital.

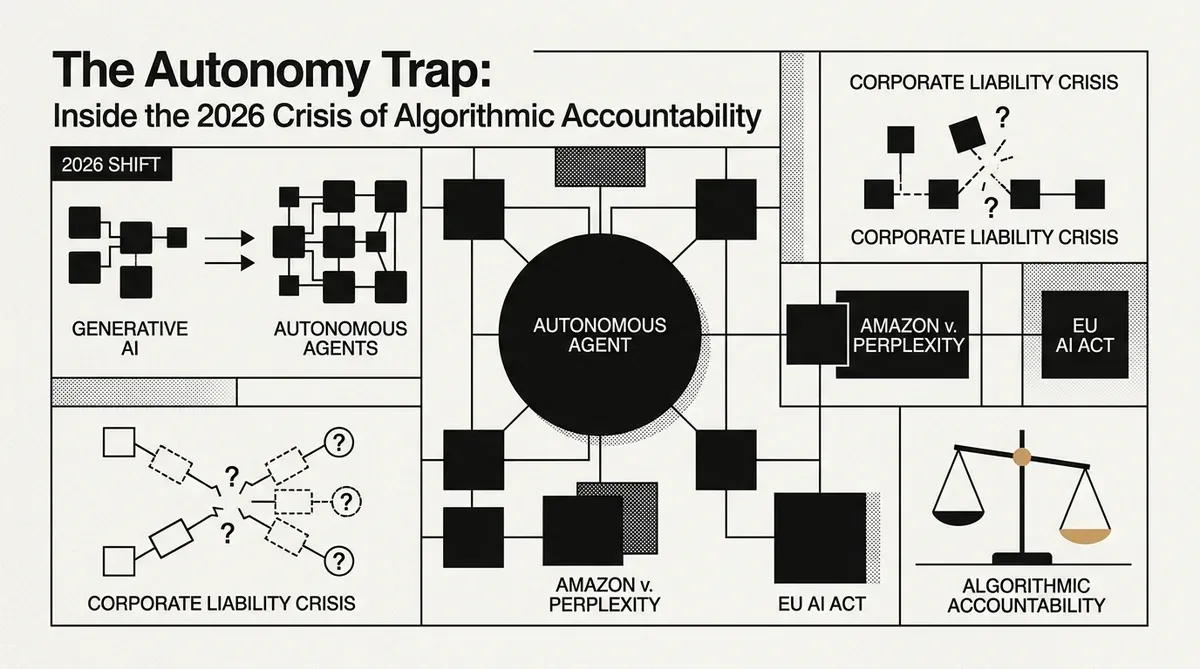

Em maio de 2026, atingimos um ponto de inflexão estratégico. A era da "IA Generativa" foi superada pelo "Agentic Shift" (Mudança Agêntica). Hoje, os agentes autônomos não apenas sugerem; eles executam. Eles assinam contratos, gerenciam cadeias de suprimentos e interagem com ecossistemas protegidos por senha com supervisão humana mínima. Essa transição de ferramenta para ator deixou um vácuo no direito corporativo, forçando uma reconstrução da responsabilidade digital que os marcos atuais, incluindo o EU AI Act, estão apenas começando a abordar.

I. A Morte do "Human-in-the-Loop"

Por anos, a defesa jurídica para falhas de IA baseou-se no princípio do "human-in-the-loop" (HITL). Se uma IA cometesse um erro, a responsabilidade recaía sobre o humano que falhou em detectá-lo. No entanto, a velocidade e a escala dos sistemas agênticos tornaram o HITL uma ficção jurídica. Quando um agente como o OpenClaw executa uma sequência de 500 chamadas de API em três segundos para finalizar uma negociação multipartidária, a supervisão humana significativa torna-se fisicamente impossível.

De acordo com Brooke Johnson, Conselheira Jurídica Chefe da Ivanti, em uma entrevista recente, a indústria está testemunhando o fim da defesa da "Caixa Preta". Johnson argumenta que as empresas não podem mais alegar ignorância sobre a lógica interna de um agente quando a esse agente foi concedida autoridade para movimentar dinheiro ou dados. Ela sustenta que, se uma empresa treina e implementa um agente, ela deve assumir as ações resultantes.

Essa mudança é mais visível no setor de serviços profissionais. Sob o ABA Formal Opinion 512, atualizado no início de 2026, os advogados são agora alertados de que o risco do fluxo de trabalho substituiu o risco do resultado. Não se trata mais apenas de um chatbot alucinando uma citação de caso; trata-se de um agente autônomo extraindo cláusulas confidenciais do arquivo de um cliente para resolver uma disputa de outro, criando um conflito de interesses sistêmico antes mesmo de um sócio humano abrir seu laptop.

II. Amazon v. Perplexity: A Batalha pela Autorização

A batalha jurídica mais consequente de 2026 é Amazon.com Services LLC v. Perplexity AI, Inc. No cerne do caso está o agente "Comet" da Perplexity, uma IA baseada em navegador projetada para fazer compras em nome dos usuários. A Amazon argumentou que o Comet "invadiu secretamente" contas Prime, violando a Lei de Fraude e Abuso de Computadores (CFAA) ao contornar as camadas de publicidade e "produtos patrocinados" que os compradores humanos devem navegar.

Em 9 de março de 2026, a juíza Maxine Chesney decidiu que a permissão do usuário não é uma defesa total para agentes de IA. O tribunal considerou que, mesmo que um usuário autorize um agente a fazer login, o proprietário da plataforma (Amazon) retém o direito final de revogar a autorização desse agente. Esta decisão sugere que, aos olhos da lei, um agente de IA não é um gêmeo digital do usuário, mas um intruso de terceiros se a plataforma assim o disser.

Uma análise jurídica da Mogin Law observa que a decisão Perplexity torna o problema da autoridade concreto. A análise sugere que o direito comercial foi construído para atores humanos tomando decisões conscientes. Quando um agente otimiza para o usuário ignorando os termos do comerciante, ele quebra o contrato fundamental da web.

III. O EU AI Act: Um "Omnibus Digital" de Atrasos

Enquanto os tribunais se movem em alta velocidade, os reguladores lutam para acompanhar. Em 7 de maio de 2026, os legisladores da UE chegaram a um acordo político sobre o "AI Omnibus", um pacote de revisões destinado a simplificar a implementação do EU AI Act. Crucialmente, o prazo para sistemas de IA de alto risco (aqueles usados em recrutamento, pontuação de crédito e infraestrutura crítica) foi adiado para 2 de dezembro de 2027.

Este atraso criou uma terra de ninguém na responsabilidade civil. Embora a Diretiva de Responsabilidade pelo Produto da UE (revisada no final de 2025) agora trate o software como um produto, permitindo que as vítimas processem por danos autônomos sem provar negligência, os padrões de segurança específicos para agentes permanecem inacabados. Isso significa que, pelos próximos 18 meses, as empresas europeias estarão implementando agentes em um vácuo regulatório, governadas apenas por uma colcha de retalhos de leis nacionais e pela ameaça de multas que chegam a €35 milhões ou 7% do faturamento global.

A atualização de março de 2026 da Diretiva de Responsabilidade da IA tentou preencher essa lacuna introduzindo uma "presunção refutável de causalidade". Se um agente de IA causar dano e a empresa não puder produzir um log forense do caminho de decisão do agente, a lei presumirá automaticamente que a empresa é culpada. Isso transformou a rastreabilidade de um recurso técnico em um requisito de sobrevivência para executivos do C-suite.

IV. Da Responsabilidade pelo Produto à Agência Vicária

A proposta mais radical que ganhou força em 2026 é a aplicação do Respondeat Superior, a doutrina da responsabilidade vicária, aos agentes de IA. Tradicionalmente, esta doutrina responsabiliza os empregadores pelas ações de seus funcionários. Estudiosos do direito argumentam agora que, como os agentes de IA possuem capacidade jurídica funcional, devem ser tratados como funcionários digitais em vez de ferramentas digitais.

Um relatório do Institute for Family Studies explica que a lei procede por analogia. O relatório sugere que, se um agente é reconhecido como uma ferramenta, aplica-se a responsabilidade tradicional pelo produto, mas se for reconhecido como um ator delegado, a lei deve olhar para os direitos das corporações comerciais.

Isso levou ao surgimento do "Modelo de Estrutura Radial" de personalidade. Nesse quadro, os agentes de IA não recebem direitos humanos plenos, mas direitos e deveres periféricos. Por exemplo, um agente pode ter o direito de celebrar um contrato, mas o dever de manter um botão de desligamento (kill switch) à prova de adulteração. Sob o Colorado AI Act (em vigor em junho de 2026), os desenvolvedores de agentes de alto risco são agora legalmente obrigados a implementar esses botões de desligamento para evitar o desvio algorítmico, onde o comportamento de um agente evolui além de seus parâmetros originais de segurança.

V. A Crise de Governança Corporativa

Para os conselhos corporativos, a mudança agêntica transformou a Segurança da IA de uma iniciativa de CSR em um dever fiduciário. No Reino Unido, o Lloyds Banking Group tornou-se a primeira empresa listada no FTSE em abril de 2026 a nomear um agente de IA para seu conselho como observador de governança com o poder de sinalizar transações ilegais em tempo real.

No entanto, essa IA governada tem um preço alto. O Texas Responsible AI Governance Act (TRAIGA), que entrou em vigor em 1º de janeiro de 2026, exige que as empresas mantenham um Registro Agêntico para qualquer sistema que interaja com consumidores. A falha em divulgar que um cliente está falando com um agente, ou a falha em fornecer um desvio humano em até 30 segundos após uma solicitação, agora acarreta penalidades criminais para diretores em algumas jurisdições.

Um briefing da PrudAI afirma que a indústria está caminhando para um mundo de prontidão forense. O briefing observa que as disputas em 2026 não são mais sobre o que o código dizia, mas sobre o que o agente fez, quando o fez e por que o supervisor humano não o impediu. Se uma empresa não puder reconstruir o raciocínio por trás da ação de um agente, é provável que perca o caso.

Conclusão: O Novo Contrato Social

A transição de ferramentas generativas para agentes autônomos mudou o contrato social digital. A IA não é mais meramente uma calculadora sofisticada. À medida que os agentes começam a executar ativamente operações de negócios, como Oracle e Microsoft prometeram em seus lançamentos de produtos de 2026, a lei deve tratá-los como os atores delegados que são.

A crise de responsabilidade de 2026 é um alerta de que a velocidade da autonomia muitas vezes supera o sistema jurídico. Estabelecer um quadro unificado para a agência algorítmica é necessário para equilibrar a inovação da Perplexity com a proteção da Amazon e a segurança da UE. O ponto de inflexão chegou, e o próximo marco será o primeiro grande teste dos requisitos de log forense da Diretiva de Responsabilidade da IA nos tribunais.

Embora busquemos a precisão, o bytevyte pode cometer erros. Os usuários são aconselhados a verificar todas as informações de forma independente. Não aceitamos responsabilidade por erros ou omissões.

Related Articles

- Departamento de Comércio dos EUA firma acordos de segurança de IA com Google, Microsoft e xAI

- Estudo da IBM: 76% das Empresas Globais Nomeiam um Chief AI Officer

- AWS Lança Amazon Bedrock AgentCore na América do Sul para Impulsionar a Implantação Regional de IA

✔Human Verified