Australische Regulierungsbehörde schreibt strengere AI Governance für Finanzinstitute vor

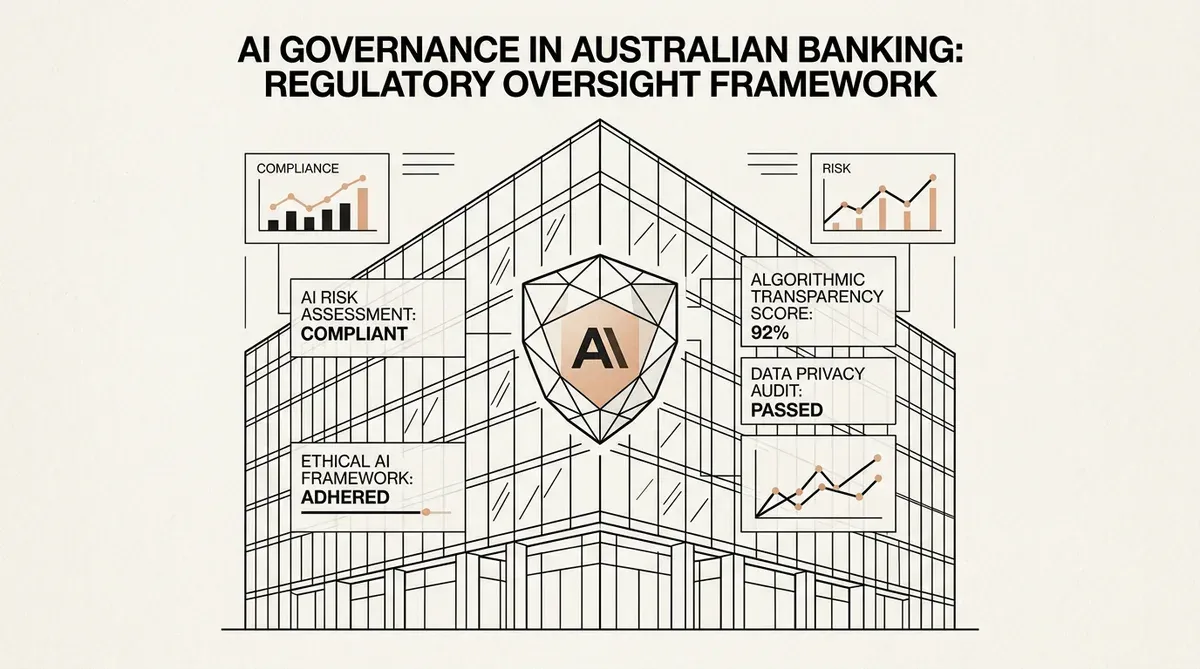

The Australian Prudential Regulation Authority (APRA) hat eine formelle Richtlinie an die Finanzdienstleistungsbranche herausgegeben, die einen signifikanten Wandel im Umgang von Banken und Versicherern mit künstlicher Intelligenz fordert. In einem diese Woche veröffentlichten Schreiben betonte die Aufsichtsbehörde die Notwendigkeit für einen Paradigmenwechsel in der AI Governance, um sicherzustellen, dass Risikomanagement-Frameworks mit der rasanten Einführung generativer Technologien Schritt halten.

Eine kürzlich von der Behörde durchgeführte Überprüfung ergab, dass das Experimentieren mit Frontier-Modellen zwar branchenweit verbreitet ist, die internen Kontrollen jedoch häufig unzureichend sind. Die APRA äußerte besondere Besorgnis hinsichtlich des Einsatzes fortschrittlicher Systeme wie Claude Mythos in kundennahen Umgebungen. Die Regulierungsbehörde stellte fest, dass die Nutzung dieser Large Language Models ohne strenge Aufsicht erhebliche operative Risiken und Reputationsrisiken für die regulierten Unternehmen darstellt.

Umgang mit Modell-Halluzinationen und Drittanbieterrisiken

Die Richtlinie hebt hervor, dass Finanzinstitute ihren Paradigmenwechsel in der AI Governance verbessern müssen, indem sie eine bessere Kontrolle über externe Technologieanbieter nachweisen. Die APRA wies darauf hin, dass Unternehmen derzeit Schwierigkeiten haben, die spezifischen Risiken im Zusammenhang mit Modell-Halluzinationen zu bewältigen, bei denen die KI falsche oder irreführende Informationen generiert. Die Behörde erwartet von den Vorständen eine größere Rechenschaftspflicht für die Leistung und Sicherheit dieser automatisierten Systeme, bevor diese weiter skaliert werden.

Die operative Resilienz ist ein Kernpunkt der neuen Erwartungen. Die APRA erklärte, dass Unternehmen sicherstellen müssen, dass ihre KI-Implementierungen keine systemischen Schwachstellen schaffen. Dies beinhaltet die Aufrechterhaltung einer klaren Sichtbarkeit in der Lieferkette von KI-Modellen und die Sicherstellung, dass Drittanbieterrisiken durch robuste vertragliche und technische Schutzmaßnahmen gemindert werden.

Um die Einhaltung dieser Standards zu gewährleisten, bereitet die Aufsichtsbehörde die Einführung neuer Reporting-Frameworks vor. Ab der zweiten Jahreshälfte 2026 werden Finanzunternehmen verpflichtet sein, detaillierte Angaben zu ihrer KI-Nutzung und ihren Risikominderungsstrategien zu machen. Dieser Schritt steht im Einklang mit einem breiteren globalen Trend zur verstärkten Überprüfung der Schnittstelle zwischen Artificial Intelligence und Finanzstabilität.

Obwohl wir uns um Genauigkeit bemühen, kann bytevyte Fehler machen. Den Nutzern wird empfohlen, alle Informationen unabhängig zu überprüfen. Wir übernehmen keine Haftung für Fehler oder Auslassungen.

Related Articles

- Claude Mythos Sicherheitsrisiken lösen Federal AI Summit aus

- AWS enthüllt Claude Mythos Cybersecurity und Agent Registry

- Claude Mythos Preview: Sicherheitsdurchbruch oder KI-Hype?

✔Human Verified