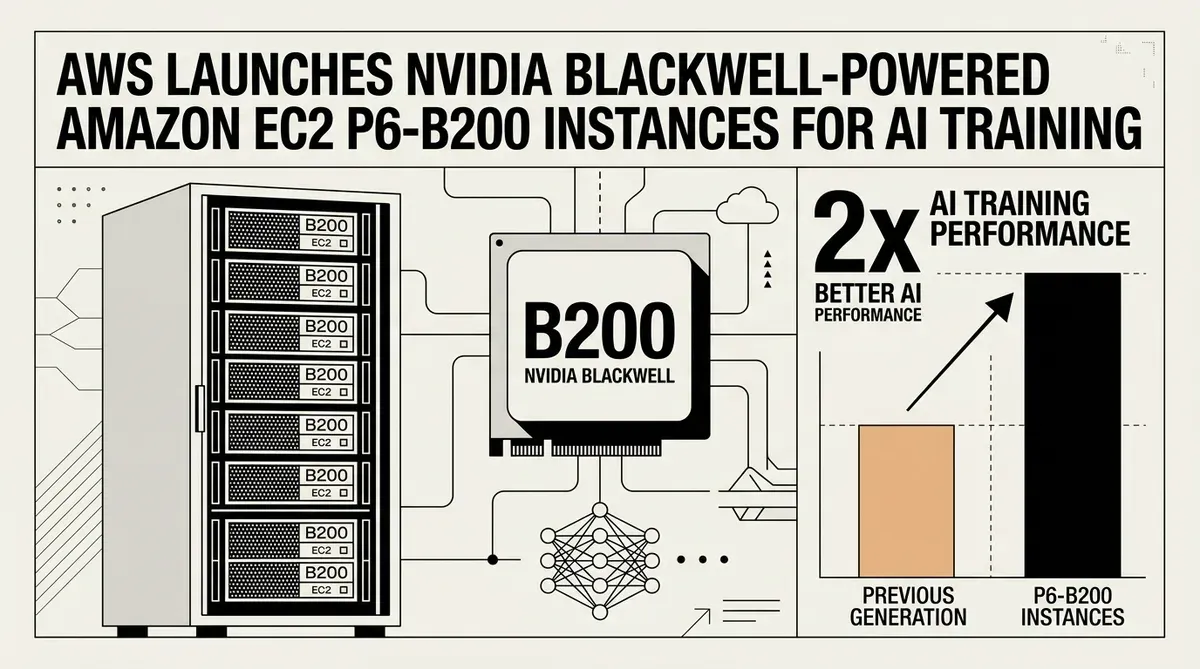

AWS führt NVIDIA Blackwell-gestützte Amazon EC2 P6-B200 Instanzen für KI-Training ein

Amazon Web Services hat die allgemeine Verfügbarkeit seiner Amazon EC2 P6-B200 Instanzen bekannt gegeben und markiert damit den ersten Cloud-Einsatz von NVIDIA Blackwell GPUs. Diese Instanzen sind ab dem 11. Mai 2026 über SageMaker Studio Notebooks zugänglich, speziell in der Region AWS US East (N. Virginia). Diese Veröffentlichung bietet Entwicklern und Data Scientists einen frühen Zugang zur Blackwell-Architektur für den Aufbau und die Verfeinerung von groß angelegten Modellen der künstlichen Intelligenz.

Die Amazon EC2 P6-B200 Plattform wurde entwickelt, um die steigenden Rechenanforderungen von generativer KI und großen Sprachmodellen zu bewältigen. Jede Instanz ist mit acht NVIDIA Blackwell GPUs ausgestattet, die insgesamt 1440 GB GPU-Speicher mit hoher Bandbreite bieten. Diese Einheiten sind mit Intel Xeon Prozessoren der 5. Generation, bekannt als Emerald Rapids, gekoppelt, um sicherzustellen, dass das Host-System mit der beschleunigten Hardware Schritt halten kann. Laut AWS liefert diese Konfiguration im Vergleich zur vorherigen Generation der P5en-Instanzen eine bis zu doppelt so hohe Leistung für KI-Trainingsaufgaben.

Strategische Auswirkungen von Blackwell in der Cloud

Die Einführung von NVIDIA Blackwell Hardware in das AWS Ökosystem stellt einen Wandel in der für die KI-Entwicklung in Unternehmen verfügbaren Infrastruktur dar. Durch die Integration dieser Instanzen in SageMaker Studio ermöglicht AWS es Teams, Experimente mit größeren Modellen direkt in vertrauten Umgebungen wie JupyterLab oder CodeEditor durchzuführen. Diese Integration zielt darauf ab, die Reibungsverluste zwischen dem ersten Modell-Prototyping und dem Training in vollem Produktionsmaßstab zu reduzieren.

Für technische Leiter und CTOs bietet die Verfügbarkeit von Amazon EC2 P6-B200 Instanzen einen Weg, Entwicklungszyklen zu beschleunigen. Die zweifache Leistungssteigerung gegenüber P5en-Instanzen deutet darauf hin, dass die Trainingszeiten für komplexe Modelle erheblich verkürzt werden könnten, was potenziell die Gesamtbetriebskosten für KI-Projekte senkt. Dieser Leistungssprung ist besonders relevant für Organisationen, die an Frontier-Modellen arbeiten, die eine massive Speicherbandbreite und Rechendichte erfordern.

Obwohl der erste Rollout auf die Region US East (N. Virginia) beschränkt ist, hat AWS angedeutet, dass die Amazon EC2 P6-B200 Instanzen auf weitere Gebiete ausgeweitet werden. Diese schrittweise Bereitstellung folgt dem Standardmuster für Hardware mit hoher Nachfrage und ermöglicht es dem Unternehmen, Lieferkettenengpässe zu bewältigen und gleichzeitig sofortigen Zugang zu wichtigen Entwicklungszentren zu bieten. Organisationen, die die NVIDIA Blackwell Architektur nutzen möchten, können nun damit beginnen, Workloads auf die neuen Instanzen zu migrieren, um von der erhöhten Speicherkapazität und Rechenleistung zu profitieren.

Obwohl wir uns um Genauigkeit bemühen, kann bytevyte Fehler machen. Benutzern wird empfohlen, alle Informationen unabhängig zu überprüfen. Wir übernehmen keine Haftung für Fehler oder Auslassungen.

Related Articles

- AWS führt Amazon EC2 P6-B300 Instanzen mit NVIDIA Blackwell Ultra GPUs ein

- AWS integriert NVIDIA Blackwell GPUs in SageMaker mit neuen G7e-Instanzen

- AWS senkt KI-Kosten mit Nova model distillation

✔Human Verified