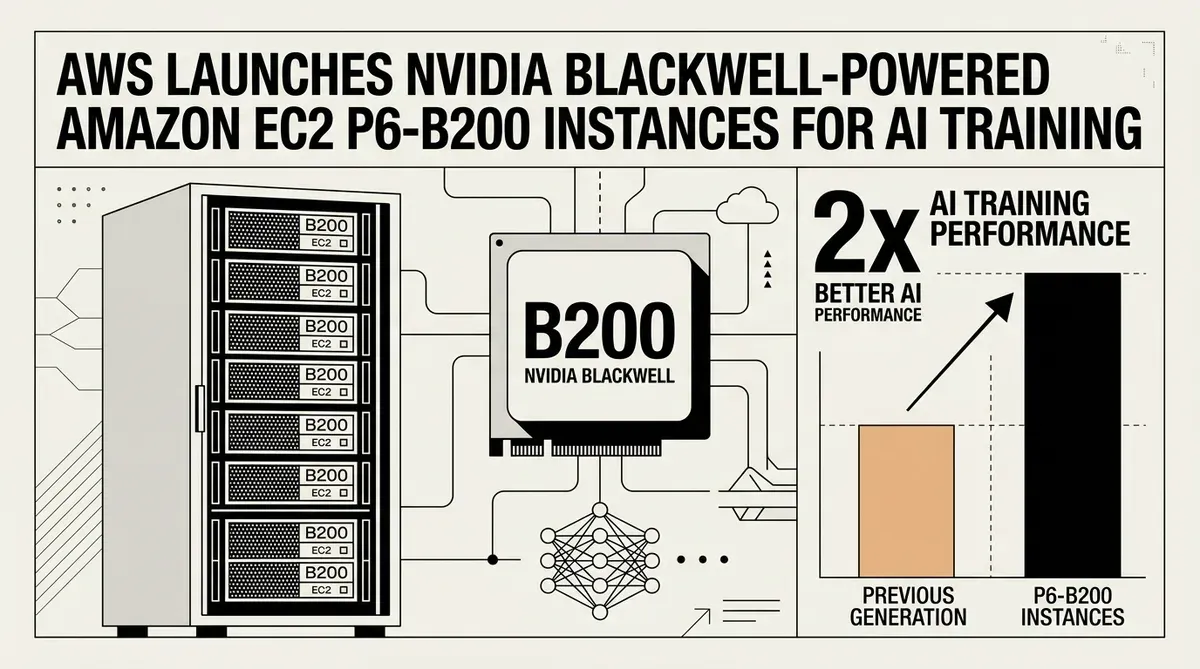

AWS Lança Instâncias Amazon EC2 P6-B200 com NVIDIA Blackwell para Treinamento de IA

Amazon Web Services lançou a disponibilidade geral de suas instâncias Amazon EC2 P6-B200, marcando a primeira implementação em nuvem de GPUs NVIDIA Blackwell. Estas instâncias já estão acessíveis através de notebooks do SageMaker Studio, especificamente na região AWS US East (N. Virginia) desde 11 de maio de 2026. Este lançamento oferece a desenvolvedores e cientistas de dados acesso antecipado à arquitetura Blackwell para construir e refinar modelos de inteligência artificial em larga escala.

A plataforma Amazon EC2 P6-B200 foi projetada para lidar com as crescentes demandas computacionais de IA generativa e grandes modelos de linguagem (LLMs). Cada instância é equipada com oito GPUs NVIDIA Blackwell, fornecendo um total de 1440 GB de memória GPU de alta largura de banda. Estas unidades são combinadas com processadores Intel Xeon de 5ª Geração, conhecidos como Emerald Rapids, para garantir que o sistema host acompanhe o hardware acelerado. De acordo com a AWS, esta configuração entrega até o dobro do desempenho para tarefas de treinamento de IA quando comparada às instâncias P5en da geração anterior.

Impacto Estratégico da Blackwell na Nuvem

A introdução do hardware NVIDIA Blackwell no ecossistema AWS representa uma mudança na infraestrutura disponível para o desenvolvimento de IA empresarial. Ao integrar estas instâncias ao SageMaker Studio, a AWS permite que as equipes realizem experimentos com modelos maiores diretamente em ambientes familiares como JupyterLab ou CodeEditor. Esta integração visa reduzir o atrito entre a prototipagem inicial do modelo e o treinamento de produção em escala total.

Para líderes técnicos e CTOs, a disponibilidade das instâncias Amazon EC2 P6-B200 oferece um caminho para acelerar os ciclos de desenvolvimento. O aumento de 2x no desempenho em relação às instâncias P5en sugere que os tempos de treinamento para modelos complexos podem ser significativamente reduzidos, potencialmente baixando o custo total de propriedade para projetos de IA. Este salto de performance é particularmente relevante para organizações que trabalham em modelos de fronteira que exigem largura de banda de memória e densidade computacional massivas.

Embora o lançamento inicial esteja limitado à região US East (N. Virginia), a AWS indicou que as instâncias Amazon EC2 P6-B200 serão expandidas para territórios adicionais. Esta implantação em fases segue o padrão padrão para hardware de alta demanda, permitindo que a empresa gerencie restrições na cadeia de suprimentos enquanto fornece acesso imediato aos principais centros de desenvolvimento. Organizações que buscam aproveitar a arquitetura NVIDIA Blackwell podem agora começar a migrar cargas de trabalho para as novas instâncias para tirar proveito da maior capacidade de memória e poder de processamento.

Embora busquemos a precisão, o bytevyte pode cometer erros. Os usuários são aconselhados a verificar todas as informações de forma independente. Não aceitamos responsabilidade por erros ou omissões.

Related Articles

- AWS Estreia Instâncias Amazon EC2 P6-B300 com GPUs NVIDIA Blackwell Ultra

- AWS Integra GPUs NVIDIA Blackwell ao SageMaker com Novas Instâncias G7e

- AWS Lança Amazon Bedrock AgentCore na América do Sul para Impulsionar a Implantação Regional de IA

✔Human Verified