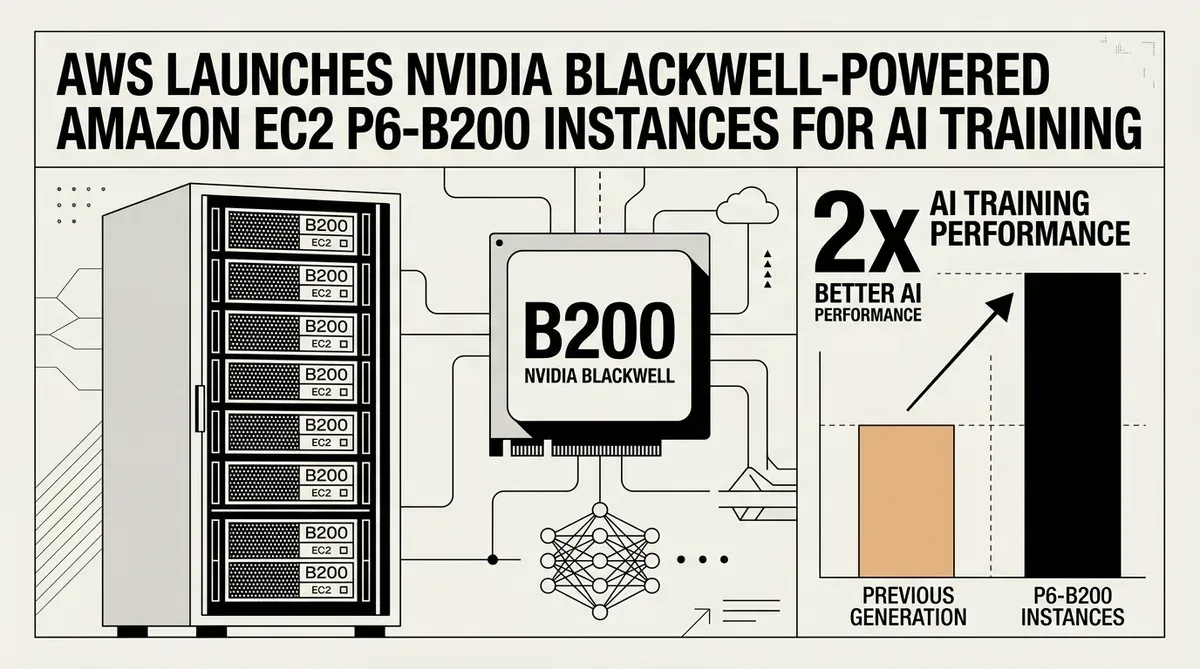

AWS lance les instances Amazon EC2 P6-B200 propulsées par NVIDIA Blackwell pour l'entraînement de l'IA

Amazon Web Services a lancé la disponibilité générale de ses instances Amazon EC2 P6-B200, marquant le premier déploiement cloud des GPU NVIDIA Blackwell. Ces instances sont désormais accessibles via les notebooks SageMaker Studio, spécifiquement dans la région AWS US East (N. Virginia) depuis le 11 mai 2026. Cette version offre aux développeurs et aux data scientists un accès anticipé à l'architecture Blackwell pour construire et affiner des modèles d'intelligence artificielle à grande échelle.

La plateforme Amazon EC2 P6-B200 est conçue pour répondre aux exigences de calcul croissantes de l'IA générative et des grands modèles de langage. Chaque instance est équipée de huit GPU NVIDIA Blackwell, offrant un total de 1440 Go de mémoire GPU à haute bande passante. Ces unités sont associées à des processeurs Intel Xeon de 5e génération, connus sous le nom d'Emerald Rapids, pour garantir que le système hôte puisse suivre le rythme du matériel accéléré. Selon AWS, cette configuration offre jusqu'à deux fois plus de performances pour les tâches d'entraînement de l'IA par rapport aux instances P5en de la génération précédente.

Impact stratégique de Blackwell dans le Cloud

L'introduction du matériel NVIDIA Blackwell dans l'écosystème AWS représente un tournant dans l'infrastructure disponible pour le développement de l'IA en entreprise. En intégrant ces instances dans SageMaker Studio, AWS permet aux équipes de mener des expériences avec des modèles plus volumineux directement dans des environnements familiers tels que JupyterLab ou CodeEditor. Cette intégration vise à réduire les frictions entre le prototypage initial du modèle et l'entraînement en production à pleine échelle.

Pour les responsables techniques et les CTO, la disponibilité des instances Amazon EC2 P6-B200 offre une voie pour accélérer les cycles de développement. L'augmentation des performances de 2x par rapport aux instances P5en suggère que les temps d'entraînement pour les modèles complexes pourraient être considérablement réduits, abaissant potentiellement le coût total de possession des projets d'IA. Ce bond de performance est particulièrement pertinent pour les organisations travaillant sur des modèles de pointe qui nécessitent une bande passante mémoire et une densité de calcul massives.

Bien que le déploiement initial soit limité à la région US East (N. Virginia), AWS a indiqué que les instances Amazon EC2 P6-B200 s'étendront à d'autres territoires. Ce déploiement progressif suit le schéma standard pour le matériel à forte demande, permettant à l'entreprise de gérer les contraintes de la chaîne d'approvisionnement tout en offrant un accès immédiat aux principaux centres de développement. Les organisations souhaitant tirer parti de l'architecture NVIDIA Blackwell peuvent désormais commencer à migrer leurs charges de travail vers les nouvelles instances pour profiter de la capacité mémoire et de la puissance de traitement accrues.

Bien que nous nous efforcions d'être précis, bytevyte peut commettre des erreurs. Il est conseillé aux utilisateurs de vérifier toutes les informations de manière indépendante. Nous déclinons toute responsabilité en cas d'erreurs ou d'omissions.

Related Articles

- AWS lance les instances Amazon EC2 P6-B300 équipées de GPU NVIDIA Blackwell Ultra

- AWS intègre les GPU NVIDIA Blackwell dans SageMaker avec les nouvelles instances G7e

- Intel et Google Cloud boostent les performances de l'IA avec Xeon 6 et du silicium personnalisé

✔Human Verified