Databricks habilita el acceso de motores externos a Unity Catalog mediante APIs abiertas

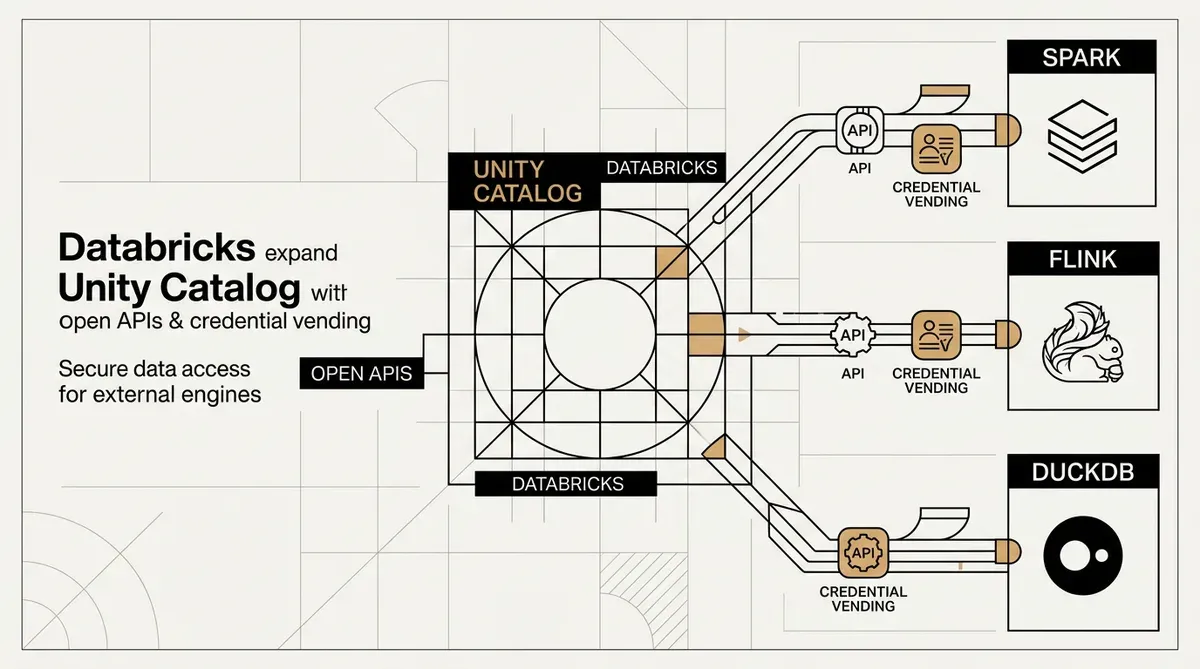

Databricks ha incrementado la interoperabilidad de su Unity Catalog mediante el lanzamiento de APIs abiertas y la disponibilidad general de credential vending. Estas actualizaciones permiten que entornos de computación de terceros interactúen con Delta tables gestionadas. Herramientas como Apache Spark, Flink y DuckDB ahora pueden ejecutar operaciones de datos completas, incluyendo la creación y actualización de tablas, directamente dentro del catálogo. El sistema utiliza un nuevo estándar abierto para catalog commits con el fin de mantener la integridad transaccional y admitir escrituras simultáneas en diferentes plataformas.

La actualización elimina las barreras técnicas asociadas con los sistemas de gobernanza de datos propietarios. Al abrir Unity Catalog, Databricks permite que las empresas utilicen una única capa de gobernanza mientras eligen motores de procesamiento específicos para diferentes tareas. La seguridad para los pipelines de larga duración se gestiona a través de OAuth machine-to-machine (M2M) y la renovación automatizada de credenciales.

Detalles técnicos de Credential Vending

El credential vending ya está disponible de forma general para el acceso seguro a los datos. Este sistema emite tokens temporales de acceso limitado a motores de computación externos, lo que sustituye la necesidad de credenciales estáticas permanentes. Databricks también ha lanzado una vista previa pública de esta función para Volumes. Esta extensión proporciona acceso gobernado a tipos de datos no estructurados, incluidos archivos de vídeo e imagen.

El uso de APIs abiertas en el entorno de Unity Catalog proporciona más flexibilidad para los sistemas de IA empresarial. A medida que las organizaciones crean modelos de IA más avanzados, requieren un acceso seguro a datos gobernados a través de múltiples motores. Databricks tiene previsto añadir controles de acceso basados en atributos (ABAC) en versiones posteriores. Estos controles permitirán a los administradores establecer políticas de seguridad a nivel de fila y columna para las lecturas de datos externos.

También están disponibles nuevas funciones de rendimiento. Predictive Optimization aumenta la velocidad de las consultas hasta 20 veces y reduce los gastos de almacenamiento en un 50 por ciento. Estas mejoras están destinadas a reducir el coste total de la gestión de grandes conjuntos de datos, manteniendo al mismo tiempo un amplio acceso a Unity Catalog.

El marco ampliado de Unity Catalog integra las Delta tables en flujos de trabajo más diversos. Databricks está utilizando estándares abiertos para los commits transaccionales para convertir su capa de gobernanza en un conector estándar para los stacks de datos. Las organizaciones pueden utilizar DuckDB para tareas de datos locales o Flink para streaming, manteniendo la seguridad y la auditoría centralizadas en Unity Catalog.

Aunque nos esforzamos por la exactitud, bytevyte puede cometer errores. Se aconseja a los usuarios verificar toda la información de forma independiente. No aceptamos ninguna responsabilidad por errores u omisiones.

Related Articles

- Databricks automatiza la integración de datos con la nueva función Native Lakehouse Sync

- Databricks lanza Genie Agent Mode para el análisis de datos

- Databricks Unity AI Gateway añade gobernanza para IA agéntica

✔Human Verified