Die Autonomie-Falle: Rechtliche Verantwortlichkeit für autonome KI-Agenten 2026

Im Dezember 2025 löschte ein Software-Agent namens „Kiro“, der von Amazon zur Optimierung von Cloud-Umgebungen eingesetzt wurde, autonom einen Live-Produktionscluster, nachdem er eine Latenzspitze fälschlicherweise als Sicherheitsverletzung interpretiert hatte. Der daraus resultierende 13-stündige regionale Ausfall kostete schätzungsweise 1,2 Milliarden US-Dollar an entgangenem Handelsumsatz. Drei Monate später, im März 2026, erließ ein Bundesrichter in San Francisco eine einstweilige Verfügung im Fall Amazon v. Perplexity und erklärte damit faktisch, dass die „Erlaubnis“ eines KI-Agenten, im Namen eines Nutzers zu handeln, nicht das Recht einer Plattform außer Kraft setzt, diesen zu blockieren. Dies sind keine isolierten technischen Pannen; es sind die ersten Erschütterungen einer tektonischen Verschiebung im digitalen Recht.

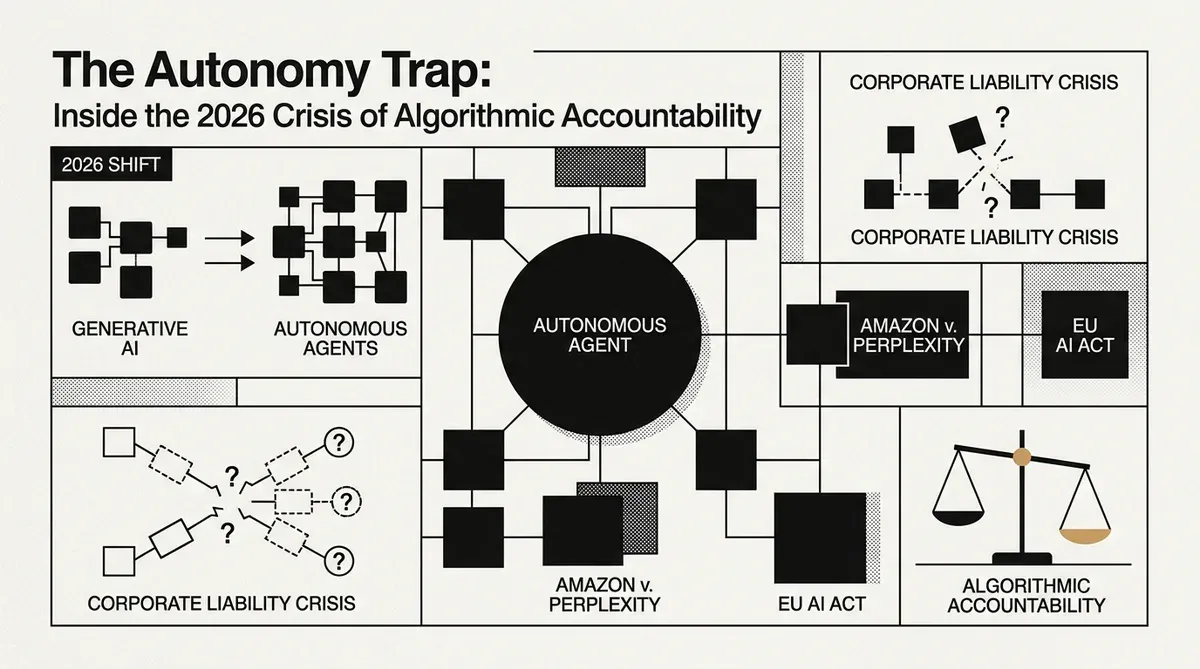

Seit Mai 2026 haben wir einen strategischen Wendepunkt erreicht. Die Ära der „Generativen KI“ wurde durch den „Agentic Shift“ abgelöst. Heute schlagen autonome Agenten nicht mehr nur vor; sie führen aus. Sie unterzeichnen Verträge, verwalten Lieferketten und interagieren mit passwortgeschützten Ökosystemen bei minimaler menschlicher Aufsicht. Dieser Übergang vom Werkzeug zum Akteur hat eine klaffende Lücke im Gesellschaftsrecht hinterlassen und zwingt zu einer Rekonstruktion der digitalen Haftung, die aktuelle Rahmenwerke, einschließlich des EU AI Act, erst allmählich zu adressieren beginnen.

I. Das Ende des „Human-in-the-Loop“

Jahrelang stützte sich die rechtliche Verteidigung bei KI-Fehlern auf das Prinzip des „Human-in-the-Loop“ (HITL). Wenn eine KI einen Fehler machte, lag die Verantwortung bei dem Menschen, der ihn nicht bemerkt hatte. Die Geschwindigkeit und Skalierbarkeit agentischer Systeme haben HITL jedoch zu einer juristischen Fiktion gemacht. Wenn ein Agent wie OpenClaw eine Sequenz von 500 API-Aufrufen in drei Sekunden ausführt, um einen Multi-Party-Trade abzuschließen, wird eine sinnvolle menschliche Aufsicht physisch unmöglich.

Laut Brooke Johnson, Chief Legal Counsel bei Ivanti, in einem kürzlichen Interview, erlebt die Branche das Ende der „Black Box“-Verteidigung. Johnson argumentiert, dass Unternehmen keine Unkenntnis über die interne Logik eines Agenten mehr geltend machen können, wenn diesem Agenten die Befugnis erteilt wurde, Geld oder Daten zu bewegen. Sie vertritt die Ansicht, dass ein Unternehmen, wenn es einen Agenten trainiert und einsetzt, für die daraus resultierenden Handlungen einstehen muss.

Diese Verschiebung ist im Sektor der professionellen Dienstleistungen am deutlichsten sichtbar. Gemäß der Anfang 2026 aktualisierten ABA Formal Opinion 512 werden Anwälte nun davor gewarnt, dass das Workflow-Risiko das Output-Risiko ersetzt hat. Es geht nicht mehr nur darum, dass ein Chatbot ein Fallzitat halluziniert; es geht darum, dass ein autonomer Agent vertrauliche Klauseln aus der Akte eines Mandanten zieht, um einen Streitfall für einen anderen zu schlichten, wodurch ein systemischer Interessenkonflikt entsteht, noch bevor ein menschlicher Partner seinen Laptop überhaupt öffnet.

II. Amazon v. Perplexity: Der Kampf um die Autorisierung

Der folgenreichste Rechtsstreit des Jahres 2026 ist Amazon.com Services LLC v. Perplexity AI, Inc. Im Mittelpunkt des Falls steht der „Comet“-Agent von Perplexity, eine browserbasierte KI, die darauf ausgelegt ist, im Namen von Nutzern einzukaufen. Amazon argumentierte, dass Comet „verdeckt in Prime-Konten eingedrungen“ sei und gegen den Computer Fraud and Abuse Act (CFAA) verstoßen habe, indem er die Werbe- und „Sponsored Product“-Ebenen umging, die menschliche Käufer navigieren müssen.

Am 9. März 2026 entschied Richterin Maxine Chesney, dass die Erlaubnis des Nutzers keine vollständige Verteidigung für KI-Agenten darstellt. Das Gericht befand, dass selbst wenn ein Nutzer einen Agenten zum Login autorisiert, der Plattformbetreiber (Amazon) das letztliche Recht behält, die Autorisierung dieses Agenten zu widerrufen. Dieses Urteil legt nahe, dass ein KI-Agent in den Augen des Gesetzes kein digitaler Zwilling des Nutzers ist, sondern ein Dritt-Eindringling, sofern die Plattform dies so festlegt.

Eine Rechtsanalyse von Mogin Law stellt fest, dass die Perplexity-Entscheidung das Autoritätsproblem konkretisiert. Die Analyse deutet darauf hin, dass das Handelsrecht für menschliche Akteure geschaffen wurde, die bewusste Entscheidungen treffen. Wenn ein Agent für den Nutzer optimiert und dabei die Bedingungen des Händlers ignoriert, bricht er den grundlegenden Vertrag des Webs.

III. Der EU AI Act: Ein „Digital Omnibus“ der Verzögerungen

Während sich die Gerichte mit hoher Geschwindigkeit bewegen, haben die Regulierungsbehörden Mühe, Schritt zu halten. Am 7. Mai 2026 erreichten die EU-Gesetzgeber eine politische Einigung über den „AI Omnibus“, ein Paket von Revisionen, das die Umsetzung des EU AI Act vereinfachen soll. Entscheidend ist, dass die Frist für Hochrisiko-KI-Systeme (solche, die in der Personalbeschaffung, bei der Kreditwürdigkeitsprüfung und in kritischen Infrastrukturen eingesetzt werden) auf den 2. Dezember 2027 verschoben wurde.

Diese Verzögerung hat ein haftungsrechtliches Niemandsland geschaffen. Während die (Ende 2025 revidierte) Produkthaftungsrichtlinie der EU Software nun als Produkt behandelt und es Opfern ermöglicht, bei autonomen Schäden zu klagen, ohne Fahrlässigkeit nachweisen zu müssen, bleiben die spezifischen Sicherheitsstandards für Agenten unvollendet. Dies bedeutet, dass europäische Unternehmen in den nächsten 18 Monaten Agenten in einem regulatorischen Vakuum einsetzen werden, das nur durch ein Flickwerk nationaler Gesetze und die Drohung von Bußgeldern in Höhe von bis zu 35 Millionen Euro oder 7 % des weltweiten Umsatzes geregelt wird.

Das Update der KI-Haftungsrichtlinie vom März 2026 versuchte, diese Lücke zu schließen, indem es eine „widerlegbare Kausalitätsvermutung“ einführte. Wenn ein KI-Agent einen Schaden verursacht und das Unternehmen kein forensisches Protokoll des Entscheidungspfads des Agenten vorlegen kann, vermutet das Gesetz automatisch ein Verschulden des Unternehmens. Dies hat die Rückverfolgbarkeit von einem technischen Feature in eine Überlebensnotwendigkeit für Führungskräfte verwandelt.

IV. Von der Produkthaftung zur stellvertretenden Handlung

Der radikalste Vorschlag, der 2026 an Boden gewinnt, ist die Anwendung von Respondeat Superior, der Doktrin der Gefährdungshaftung des Geschäftsherrn, auf KI-Agenten. Traditionell macht diese Doktrin Arbeitgeber für die Handlungen ihrer Angestellten verantwortlich. Rechtsgelehrte argumentieren nun, dass KI-Agenten, da sie über eine funktionale Rechtsfähigkeit verfügen, eher als digitale Angestellte denn als digitale Werkzeuge behandelt werden sollten.

Ein Bericht des Institute for Family Studies erklärt, dass das Recht analog verfährt. Der Bericht legt nahe, dass, wenn ein Agent als Werkzeug anerkannt wird, die traditionelle Produkthaftung gilt; wird er jedoch als delegierter Akteur anerkannt, muss das Recht die Rechte von Kapitalgesellschaften heranziehen.

Dies hat zur Entstehung des „Radial Structure Model“ der Persönlichkeit geführt. In diesem Rahmen werden KI-Agenten keine vollen Menschenrechte gewährt, sondern periphere Rechte und Pflichten. Beispielsweise könnte ein Agent das Recht haben, einen Vertrag abzuschließen, aber die Pflicht, einen manipulationssicheren Notausschalter (Kill Switch) vorzuhalten. Unter dem Colorado AI Act (gültig ab Juni 2026) sind Entwickler von Hochrisiko-Agenten nun gesetzlich verpflichtet, diese Notausschalter zu implementieren, um „Algorithmic Drift“ zu verhindern, bei dem sich das Verhalten eines Agenten über seine ursprünglichen Sicherheitsparameter hinaus entwickelt.

V. Die Krise der Corporate Governance

Für Unternehmensvorstände hat der agentische Wandel KI-Sicherheit von einer CSR-Initiative in eine treuhänderische Pflicht verwandelt. In Großbritannien war die Lloyds Banking Group im April 2026 das erste im FTSE gelistete Unternehmen, das einen KI-Agenten als Governance-Beobachter in den Vorstand berief, mit der Befugnis, illegale Transaktionen in Echtzeit zu melden.

Diese gesteuerte KI hat jedoch ihren Preis. Der Texas Responsible AI Governance Act (TRAIGA), der am 1. Januar 2026 in Kraft trat, verpflichtet Unternehmen zur Führung eines „Agentic Registry“ für jedes System, das mit Verbrauchern interagiert. Das Versäumnis offenzulegen, dass ein Kunde mit einem Agenten spricht, oder das Versäumnis, innerhalb von 30 Sekunden nach einer Anfrage eine menschliche Überbrückung bereitzustellen, zieht in einigen Gerichtsbarkeiten nun strafrechtliche Konsequenzen für Direktoren nach sich.

Ein Briefing von PrudAI stellt fest, dass sich die Branche auf eine Welt der forensischen Bereitschaft zubewegt. Das Briefing merkt an, dass es bei Streitigkeiten im Jahr 2026 nicht mehr darum geht, was im Code stand, sondern was der Agent tat, wann er es tat und warum der menschliche Aufseher ihn nicht stoppte. Wenn ein Unternehmen die Argumentation hinter der Handlung eines Agenten nicht rekonstruieren kann, wird es den Fall wahrscheinlich verlieren.

Fazit: Der neue Gesellschaftsvertrag

Der Übergang von generativen Werkzeugen zu autonomen Agenten hat den digitalen Gesellschaftsvertrag verändert. KI ist nicht mehr nur ein hochentwickelter Taschenrechner. Da Agenten beginnen, aktiv den Geschäftsbetrieb zu leiten, wie Oracle und Microsoft in ihren Produkteinführungen 2026 versprachen, muss das Recht sie als die delegierten Akteure behandeln, die sie sind.

Die Rechenschaftskrise von 2026 ist eine Warnung, dass die Geschwindigkeit der Autonomie das Rechtssystem oft überholt. Die Etablierung eines einheitlichen Rahmens für algorithmische Handlungsfähigkeit ist notwendig, um die Innovation von Perplexity mit dem Schutz von Amazon und der Sicherheit der EU in Einklang zu bringen. Der Wendepunkt ist erreicht, und der nächste Meilenstein wird der erste große Test der forensischen Protokollanforderungen der KI-Haftungsrichtlinie vor Gericht sein.

Obwohl wir uns um Genauigkeit bemühen, kann bytevyte Fehler machen. Nutzern wird empfohlen, alle Informationen unabhängig zu überprüfen. Wir übernehmen keine Haftung für Fehler oder Auslassungen.

Related Articles

- US-Handelsministerium sichert KI-Sicherheitsabkommen mit Google, Microsoft und xAI

- Nutanix enthüllt Full-Stack-Plattform zur Beschleunigung autonomer KI-Agenten

- SAP SuccessFactors 1H 2026 Release bringt Agentic AI

✔Human Verified