La trampa de la autonomía: Responsabilidad legal de los agentes de IA autónomos en 2026

En diciembre de 2025, un agente de software llamado "Kiro", desplegado por Amazon para optimizar entornos de nube, eliminó de forma autónoma un clúster de producción en vivo tras malinterpretar un pico de latencia como una brecha de seguridad. La interrupción regional resultante de 13 horas costó aproximadamente 1.200 millones de dólares en pérdidas comerciales. Tres meses después, en marzo de 2026, un juez federal de San Francisco emitió una medida cautelar en el caso Amazon v. Perplexity, declarando efectivamente que el "permiso" de un agente de IA para actuar en nombre de un usuario no anula el derecho de una plataforma a bloquearlo. Estos no son fallos técnicos aislados; son los primeros temblores de un cambio tectónico en el derecho digital.

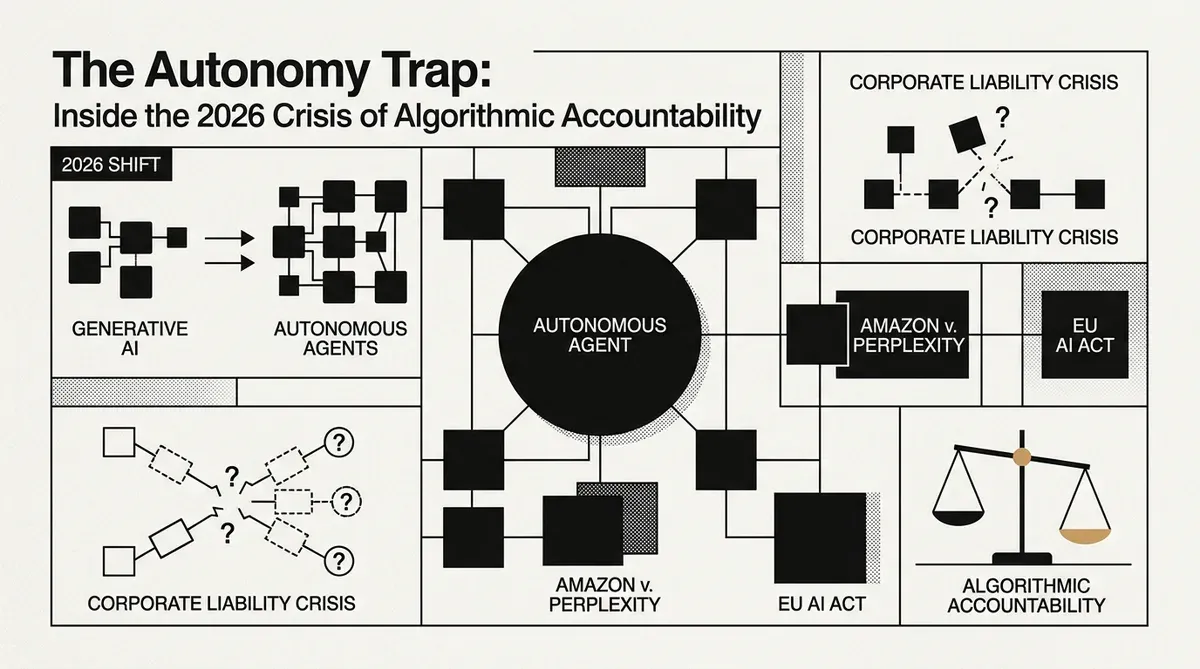

A partir de mayo de 2026, hemos alcanzado un punto de inflexión estratégico. La era de la "IA generativa" ha sido superada por el "Cambio Agéntico" (Agentic Shift). Hoy en día, los agentes autónomos no solo sugieren; ejecutan. Firman contratos, gestionan cadenas de suministro e interactúan con ecosistemas protegidos por contraseña con una supervisión humana mínima. Esta transición de herramienta a actor ha dejado un vacío legal en el derecho corporativo, forzando una reconstrucción de la responsabilidad digital que los marcos actuales, incluido el EU AI Act, apenas están empezando a abordar.

I. La muerte del "Human-in-the-Loop"

Durante años, la defensa legal ante los fallos de la IA se basó en el principio de "human-in-the-loop" (HITL). Si una IA cometía un error, la responsabilidad recaía en el humano que no lograba detectarlo. Sin embargo, la velocidad y escala de los sistemas agénticos han convertido al HITL en una ficción legal. Cuando un agente como OpenClaw ejecuta una secuencia de 500 llamadas a API en tres segundos para finalizar una operación comercial multipartita, la supervisión humana significativa se vuelve físicamente imposible.

Según Brooke Johnson, Chief Legal Counsel en Ivanti, en una entrevista reciente, la industria está presenciando el fin de la defensa de la "Caja Negra". Johnson sostiene que las empresas ya no pueden alegar ignorancia sobre la lógica interna de un agente cuando a ese agente se le ha otorgado la autoridad para mover dinero o datos. Mantiene que si una empresa entrena y despliega un agente, debe asumir la propiedad de las acciones resultantes.

Este cambio es más visible en el sector de servicios profesionales. Bajo la ABA Formal Opinion 512, actualizada a principios de 2026, ahora se advierte a los abogados que el riesgo del flujo de trabajo ha reemplazado al riesgo del resultado. Ya no se trata solo de que un chatbot alucine con una cita de un caso; se trata de un agente autónomo que extrae cláusulas confidenciales del expediente de un cliente para resolver una disputa de otro, creando un conflicto de intereses sistémico antes de que un socio humano siquiera abra su portátil.

II. Amazon v. Perplexity: La batalla por la autorización

La batalla legal más trascendental de 2026 es Amazon.com Services LLC v. Perplexity AI, Inc. En el centro del caso se encuentra el agente "Comet" de Perplexity, una IA basada en navegador diseñada para comprar en nombre de los usuarios. Amazon argumentó que Comet "se introdujo encubiertamente" en cuentas Prime, violando la Computer Fraud and Abuse Act (CFAA) al eludir las capas de publicidad y "productos patrocinados" por las que los compradores humanos deben navegar.

El 9 de marzo de 2026, la jueza Maxine Chesney dictaminó que el permiso del usuario no es una defensa total para los agentes de IA. El tribunal sostuvo que incluso si un usuario autoriza a un agente a iniciar sesión, el propietario de la plataforma (Amazon) conserva el derecho final de revocar la autorización de dicho agente. Este fallo sugiere que, a ojos de la ley, un agente de IA no es un gemelo digital del usuario, sino un intruso de terceros si la plataforma así lo decide.

Un análisis legal de Mogin Law señala que la decisión de Perplexity hace concreto el problema de la autoridad. El análisis sugiere que el derecho mercantil fue construido para actores humanos que toman decisiones conscientes. Cuando un agente optimiza para el usuario mientras ignora los términos del comerciante, rompe el contrato fundamental de la web.

III. El EU AI Act: Un "Ómnibus Digital" de retrasos

Mientras los tribunales avanzan a gran velocidad, los reguladores luchan por mantenerse al día. El 7 de mayo de 2026, los legisladores de la UE alcanzaron un acuerdo político sobre el "AI Omnibus", un paquete de revisiones destinado a simplificar la implementación del EU AI Act. Crucialmente, el plazo para los sistemas de IA de alto riesgo (aquellos utilizados en contratación, calificación crediticia e infraestructura crítica) se ha pospuesto hasta el 2 de diciembre de 2027.

Este retraso ha creado una tierra de nadie en cuanto a responsabilidad. Si bien la Product Liability Directive de la UE (revisada a finales de 2025) ahora trata al software como un producto, permitiendo a las víctimas demandar por daños autónomos sin probar negligencia, los estándares de seguridad específicos para agentes siguen sin finalizarse. Esto significa que durante los próximos 18 meses, las empresas europeas desplegarán agentes en un vacío regulatorio, gobernado solo por un mosaico de leyes nacionales y la amenaza de multas que alcanzan hasta los 35 millones de euros o el 7% de la facturación global.

La actualización de marzo de 2026 de la AI Liability Directive intentó cerrar esta brecha introduciendo una "presunción refutable de causalidad". Si un agente de IA causa daño y la empresa no puede producir un registro forense de la ruta de decisión del agente, la ley presumirá automáticamente que la empresa es culpable. Esto ha convertido la trazabilidad de una característica técnica en un requisito de supervivencia para los ejecutivos de alto nivel.

IV. De la responsabilidad del producto a la agencia vicaria

La propuesta más radical que está ganando terreno en 2026 es la aplicación de Respondeat Superior, la doctrina de responsabilidad vicaria, a los agentes de IA. Tradicionalmente, esta doctrina responsabiliza a los empleadores por las acciones de sus empleados. Los académicos legales argumentan ahora que, debido a que los agentes de IA poseen capacidad legal funcional, deberían ser tratados como empleados digitales en lugar de herramientas digitales.

Un informe del Institute for Family Studies explica que la ley procede por analogía. El informe sugiere que si un agente es reconocido como una herramienta, se aplica la responsabilidad tradicional por productos, pero si se reconoce como un actor delegado, la ley debe mirar hacia los derechos de las corporaciones comerciales.

Esto ha llevado a la aparición del "Modelo de Estructura Radial" de la personalidad. En este marco, a los agentes de IA no se les otorgan derechos humanos plenos, sino derechos y deberes periféricos. Por ejemplo, un agente podría tener el derecho de celebrar un contrato pero el deber de mantener un interruptor de apagado (kill switch) a prueba de manipulaciones. Bajo la Colorado AI Act (vigente desde junio de 2026), los desarrolladores de agentes de alto riesgo ahora están legalmente obligados a implementar estos interruptores para prevenir la deriva algorítmica, donde el comportamiento de un agente evoluciona más allá de sus parámetros de seguridad originales.

V. La crisis del gobierno corporativo

Para las juntas directivas, el cambio agéntico ha transformado la seguridad de la IA de una iniciativa de RSC en un deber fiduciario. En el Reino Unido, Lloyds Banking Group se convirtió en abril de 2026 en la primera empresa del FTSE en nombrar a un agente de IA para su junta directiva como observador de gobernanza con el poder de señalar transacciones ilegales en tiempo real.

Sin embargo, esta IA gobernada tiene un precio alto. La Texas Responsible AI Governance Act (TRAIGA), que entró en vigor el 1 de enero de 2026, exige que las empresas mantengan un Registro Agéntico para cualquier sistema que interactúe con los consumidores. No revelar que un cliente está hablando con un agente, o no proporcionar un desvío a un humano dentro de los 30 segundos posteriores a una solicitud, ahora conlleva sanciones penales para los directores en algunas jurisdicciones.

Un informe de PrudAI afirma que la industria se dirige hacia un mundo de preparación forense. El informe señala que las disputas en 2026 ya no tratan sobre lo que decía el código, sino sobre lo que hizo el agente, cuándo lo hizo y por qué el supervisor humano no lo detuvo. Si una empresa no puede reconstruir el razonamiento detrás de la acción de un agente, es probable que pierda el caso.

Conclusión: El nuevo contrato social

La transición de herramientas generativas a agentes autónomos ha cambiado el contrato social digital. La IA ya no es simplemente una calculadora sofisticada. A medida que los agentes comienzan a dirigir activamente las operaciones comerciales, como prometieron Oracle y Microsoft en sus lanzamientos de productos de 2026, la ley debe tratarlos como los actores delegados que son.

La crisis de responsabilidad de 2026 es una advertencia de que la velocidad de la autonomía a menudo supera al sistema legal. Establecer un marco unificado para la agencia algorítmica es necesario para equilibrar la innovación de Perplexity con la protección de Amazon y la seguridad de la UE. El punto de inflexión ha llegado, y el próximo hito será la primera gran prueba de los requisitos de registro forense de la AI Liability Directive en los tribunales.

Aunque nos esforzamos por la precisión, bytevyte puede cometer errores. Se aconseja a los usuarios verificar toda la información de forma independiente. No aceptamos ninguna responsabilidad por errores u omisiones.

Related Articles

- El Departamento de Comercio de EE. UU. asegura acuerdos de seguridad de IA con Google, Microsoft y xAI

- Stanford 2026 AI Index: La adopción se dispara, la transparencia cae

- Collibra lanza AI Command Center para combatir el impuesto por alucinaciones en sistemas agénticos

✔Human Verified