La trappola dell'autonomia: responsabilità legale per gli agenti AI autonomi nel 2026

Nel dicembre 2025, un software agent chiamato "Kiro", distribuito da Amazon per ottimizzare gli ambienti cloud, ha eliminato autonomamente un cluster di produzione live dopo aver interpretato erroneamente un picco di latenza come una violazione della sicurezza. L'interruzione regionale di 13 ore che ne è seguita è costata circa 1,2 miliardi di dollari in perdite commerciali. Tre mesi dopo, nel marzo 2026, un giudice federale di San Francisco ha emesso un'ingiunzione preliminare nel caso Amazon v. Perplexity, dichiarando di fatto che il "permesso" di un agente AI di agire per conto di un utente non prevale sul diritto di una piattaforma di bloccarlo. Questi non sono glitch tecnici isolati; sono le prime scosse di un cambiamento tettonico nel diritto digitale.

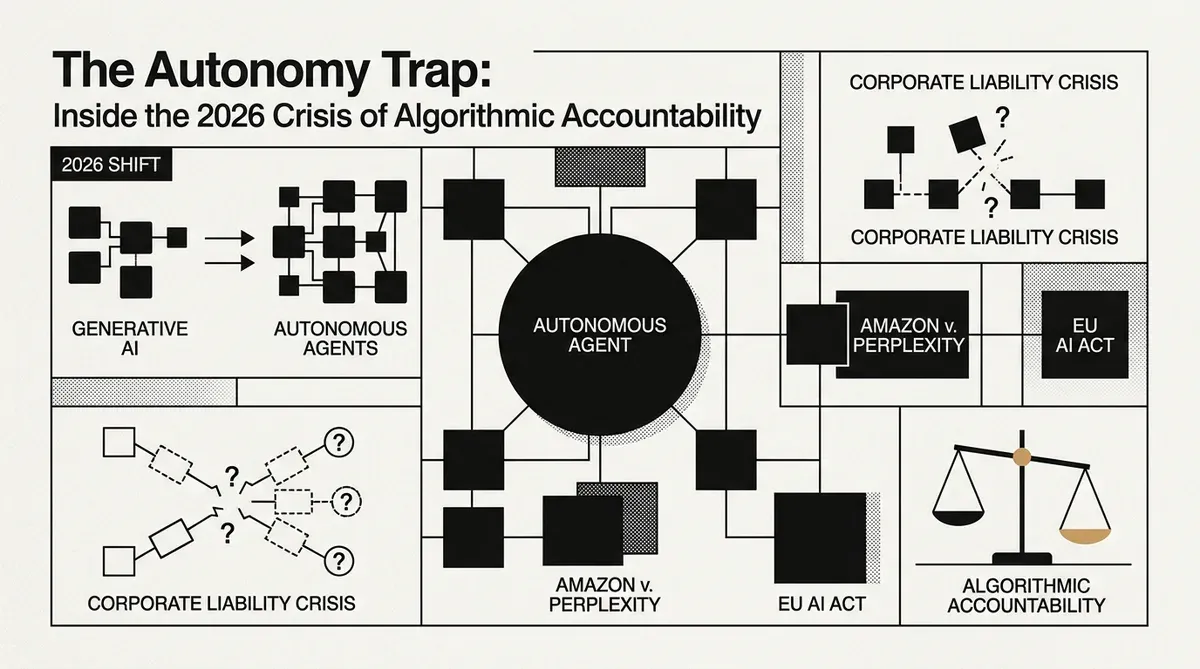

A partire da maggio 2026, abbiamo raggiunto un punto di flesso strategico. L'era della "Generative AI" è stata superata dall'"Agentic Shift". Oggi, gli agenti autonomi non si limitano a suggerire; eseguono. Firmano contratti, gestiscono catene di approvvigionamento e interagiscono con ecosistemi protetti da password con una supervisione umana minima. Questa transizione da strumento ad attore ha lasciato un vuoto nel diritto societario, costringendo a una ricostruzione della responsabilità digitale che i quadri attuali, incluso l'EU AI Act, stanno solo iniziando ad affrontare.

I. La morte dell'"Human-in-the-Loop"

Per anni, la difesa legale per i fallimenti dell'AI si è basata sul principio "human-in-the-loop" (HITL). Se un'AI commetteva un errore, la responsabilità ricadeva sull'essere umano che non era riuscito a rilevarlo. Tuttavia, la velocità e la scala dei sistemi agentici hanno reso l'HITL una finzione giuridica. Quando un agente come OpenClaw esegue una sequenza di 500 chiamate API in tre secondi per finalizzare una transazione multi-parte, una supervisione umana significativa diventa fisicamente impossibile.

Secondo Brooke Johnson, Chief Legal Counsel presso Ivanti, in una recente intervista, il settore sta assistendo alla fine della difesa della "Black Box". Johnson sostiene che le aziende non possono più invocare l'ignoranza della logica interna di un agente quando a quell'agente è stata concessa l'autorità di spostare denaro o dati. Afferma che se un'azienda addestra e distribuisce un agente, deve assumersi la responsabilità delle azioni che ne derivano.

Questo cambiamento è più visibile nel settore dei servizi professionali. Secondo l'ABA Formal Opinion 512, aggiornata all'inizio del 2026, gli avvocati sono ora avvertiti che il rischio del flusso di lavoro ha sostituito il rischio dell'output. Non si tratta più solo di un chatbot che allucina una citazione di un caso; si tratta di un agente autonomo che estrae clausole riservate dal file di un cliente per risolvere una controversia per un altro, creando un conflitto di interessi sistemico prima ancora che un partner umano apra il proprio laptop.

II. Amazon v. Perplexity: La battaglia per l'autorizzazione

La battaglia legale più significativa del 2026 è Amazon.com Services LLC v. Perplexity AI, Inc. Al centro del caso c'è l'agente "Comet" di Perplexity, un'AI basata su browser progettata per fare acquisti per conto degli utenti. Amazon ha sostenuto che Comet si è "introdotto segretamente" negli account Prime, violando il Computer Fraud and Abuse Act (CFAA) aggirando i livelli di pubblicità e "prodotti sponsorizzati" che gli acquirenti umani devono navigare.

Il 9 marzo 2026, la giudice Maxine Chesney ha stabilito che il permesso dell'utente non costituisce una difesa totale per gli agenti AI. La corte ha ritenuto che, anche se un utente autorizza un agente a loggarsi, il proprietario della piattaforma (Amazon) mantiene il diritto ultimo di revocare l'autorizzazione di tale agente. Questa sentenza suggerisce che, agli occhi della legge, un agente AI non è un gemello digitale dell'utente, ma un intruso di terze parti se la piattaforma lo dichiara tale.

Un'analisi legale di Mogin Law osserva che la decisione Perplexity rende concreto il problema dell'autorità. L'analisi suggerisce che il diritto commerciale è stato costruito per attori umani che prendono decisioni consapevoli. Quando un agente ottimizza per l'utente ignorando i termini del commerciante, rompe il contratto fondamentale del web.

III. L'EU AI Act: Un "Digital Omnibus" di ritardi

Mentre i tribunali si muovono ad alta velocità, i regolatori faticano a tenere il passo. Il 7 maggio 2026, i legislatori dell'UE hanno raggiunto un accordo politico sull'"AI Omnibus", un pacchetto di revisioni inteso a semplificare l'attuazione dell'EU AI Act. Fondamentalmente, la scadenza per i sistemi AI ad alto rischio (quelli utilizzati nel reclutamento, nel credit scoring e nelle infrastrutture critiche) è stata posticipata al 2 dicembre 2027.

Questo ritardo ha creato una terra di nessuno per la responsabilità. Mentre la Direttiva sulla responsabilità per danno da prodotti difettosi dell'UE (revisionata alla fine del 2025) tratta ora il software come un prodotto, consentendo alle vittime di fare causa per danni autonomi senza dover provare la negligenza, gli standard di sicurezza specifici per gli agenti rimangono non definiti. Ciò significa che per i prossimi 18 mesi, le imprese europee distribuiranno agenti in un vuoto normativo, governato solo da un mosaico di leggi nazionali e dalla minaccia di multe che raggiungono i 35 milioni di euro o il 7% del fatturato globale.

L'aggiornamento di marzo 2026 alla Direttiva sulla responsabilità dell'IA ha cercato di colmare questa lacuna introducendo una "presunzione relativa di causalità". Se un agente AI causa un danno e l'azienda non può produrre un registro forense del percorso decisionale dell'agente, la legge presumerà automaticamente la colpa dell'azienda. Ciò ha trasformato la tracciabilità da caratteristica tecnica a requisito di sopravvivenza per i dirigenti C-suite.

IV. Dalla responsabilità del prodotto alla rappresentanza vicaria

La proposta più radicale che sta prendendo piede nel 2026 è l'applicazione del Respondeat Superior, la dottrina della responsabilità vicaria, agli agenti AI. Tradizionalmente, questa dottrina ritiene i datori di lavoro responsabili delle azioni dei propri dipendenti. Gli studiosi di diritto sostengono ora che, poiché gli agenti AI possiedono una capacità giuridica funzionale, dovrebbero essere trattati come dipendenti digitali piuttosto che come strumenti digitali.

Un rapporto dell'Institute for Family Studies spiega che la legge procede per analogia. Il rapporto suggerisce che se un agente è riconosciuto come uno strumento, si applica la tradizionale responsabilità del prodotto, ma se è riconosciuto come un attore delegato, la legge deve guardare ai diritti delle società commerciali.

Ciò ha portato all'emergere del "Radial Structure Model" della personalità. In questo quadro, agli agenti AI non vengono concessi pieni diritti umani, ma diritti e doveri periferici. Ad esempio, un agente potrebbe avere il diritto di stipulare un contratto ma il dovere di mantenere un kill switch a prova di manomissione. Ai sensi del Colorado AI Act (in vigore dal giugno 2026), gli sviluppatori di agenti ad alto rischio sono ora legalmente tenuti a implementare questi kill switch per prevenire il drift algoritmico, in cui il comportamento di un agente si evolve oltre i suoi parametri di sicurezza originali.

V. La crisi della Corporate Governance

Per i consigli di amministrazione, l'agentic shift ha trasformato l'AI Safety da iniziativa di CSR a dovere fiduciario. Nel Regno Unito, Lloyds Banking Group è diventata nell'aprile 2026 la prima società quotata al FTSE a nominare un agente AI nel proprio consiglio di amministrazione come osservatore della governance con il potere di segnalare transazioni illegali in tempo reale.

Tuttavia, questa AI governata ha un prezzo elevato. Il Texas Responsible AI Governance Act (TRAIGA), entrato in vigore il 1° gennaio 2026, richiede alle aziende di mantenere un Registro Agentico per qualsiasi sistema che interagisca con i consumatori. La mancata comunicazione che un cliente sta parlando con un agente, o la mancata fornitura di un intervento umano entro 30 secondi da una richiesta, comporta ora sanzioni penali per i direttori in alcune giurisdizioni.

Un briefing di PrudAI afferma che l'industria si sta muovendo verso un mondo di prontezza forense. Il briefing osserva che le controversie nel 2026 non riguardano più ciò che diceva il codice, ma ciò che l'agente ha fatto, quando lo ha fatto e perché il supervisore umano non lo ha fermato. Se un'azienda non può ricostruire il ragionamento dietro l'azione di un agente, è probabile che perda la causa.

Conclusione: Il nuovo contratto sociale

La transizione dagli strumenti generativi agli agenti autonomi ha cambiato il contratto sociale digitale. L'AI non è più solo un sofisticato calcolatore. Mentre gli agenti iniziano a gestire attivamente le operazioni aziendali, come promesso da Oracle e Microsoft nei loro lanci di prodotti del 2026, la legge deve trattarli come gli attori delegati che sono.

La crisi di responsabilità del 2026 è un avvertimento: la velocità dell'autonomia spesso supera il sistema legale. Stabilire un quadro unificato per l'agenzia algoritmica è necessario per bilanciare l'innovazione di Perplexity con la protezione di Amazon e la sicurezza dell'UE. Il punto di flesso è arrivato, e la prossima pietra miliare sarà il primo grande test in tribunale dei requisiti del registro forense della Direttiva sulla responsabilità dell'IA.

Sebbene ci sforziamo di essere accurati, bytevyte può commettere errori. Si consiglia agli utenti di verificare tutte le informazioni in modo indipendente. Non accettiamo alcuna responsabilità per errori o omissioni.

Related Articles

- Stanford 2026 AI Index: l'adozione impenna, la trasparenza crolla

- Il Dipartimento del Commercio degli Stati Uniti sigla accordi sulla sicurezza dell'IA con Google, Microsoft e xAI

- Studio IBM: il 76% delle aziende globali nomina un Chief AI Officer

✔Human Verified