L'autorità di regolamentazione australiana impone una governance dell'IA più rigorosa per le istituzioni finanziarie

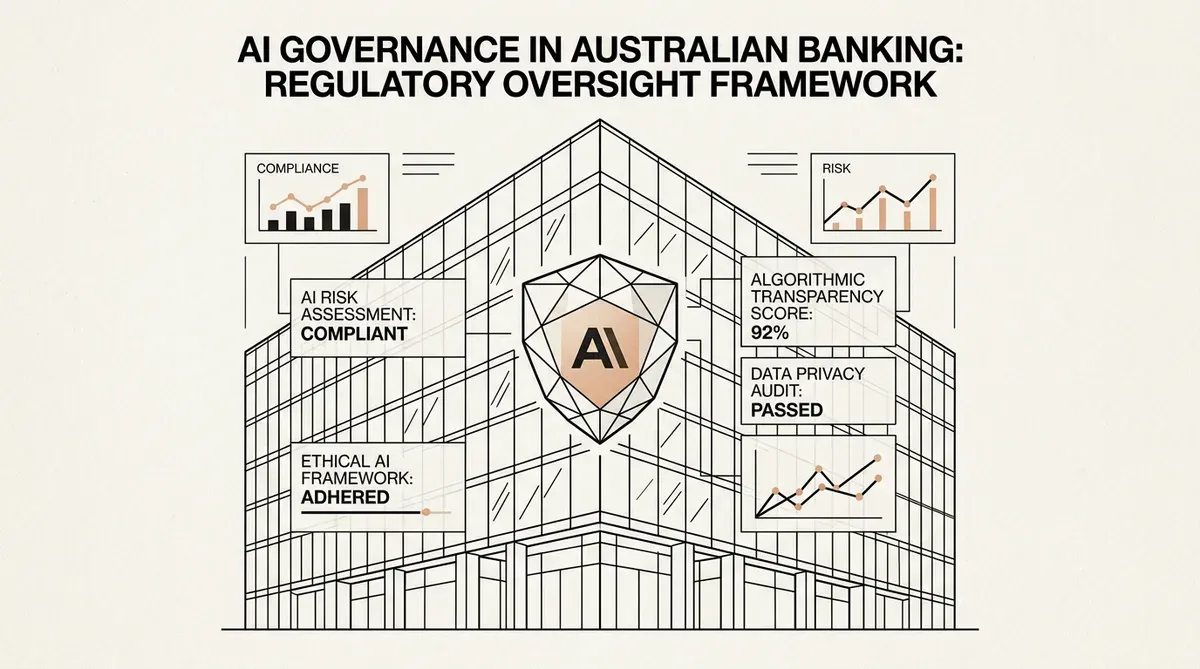

L'Australian Prudential Regulation Authority (APRA) ha emesso una direttiva formale al settore dei servizi finanziari, chiedendo un cambiamento significativo nel modo in cui banche e assicuratori gestiscono l'intelligenza artificiale. In una lettera pubblicata questa settimana, l'autorità di regolamentazione ha sottolineato la necessità di un cambio di passo nella governance dell'IA per garantire che i quadri di gestione del rischio tengano il passo con la rapida adozione delle tecnologie generative.

Una recente revisione condotta dall'autorità ha rilevato che, sebbene la sperimentazione con i frontier models sia diffusa in tutto il settore, i controlli interni sono spesso insufficienti. L'APRA ha espresso particolare preoccupazione riguardo all'implementazione di sistemi avanzati come Claude Mythos in ambienti a contatto con i clienti. Il regolatore ha osservato che l'uso di questi large language models senza una supervisione rigorosa comporta rischi operativi e reputazionali sostanziali per le entità regolamentate.

Affrontare le allucinazioni dei modelli e i rischi di terze parti

La direttiva evidenzia che le istituzioni finanziarie devono migliorare il loro cambio di passo nella governance dell'IA dimostrando un migliore controllo sui fornitori di tecnologia esterni. L'APRA ha indicato che le aziende stanno attualmente lottando per gestire i rischi specifici associati alle allucinazioni dei modelli, in cui l'IA genera informazioni false o fuorvianti. Il regolatore si aspetta che i consigli di amministrazione si assumano una maggiore responsabilità per le prestazioni e la sicurezza di questi sistemi automatizzati prima che vengano ulteriormente scalati.

La resilienza operativa è un obiettivo centrale delle nuove aspettative. L'APRA ha dichiarato che le entità devono garantire che le loro implementazioni di IA non creino vulnerabilità sistemiche. Ciò include il mantenimento di una chiara visibilità sulla catena di fornitura dei modelli di IA e la garanzia che i rischi di terze parti siano mitigati attraverso robuste salvaguardie contrattuali e tecniche.

Per garantire la conformità a questi standard, l'autorità di regolamentazione si sta preparando a introdurre nuovi quadri di reporting. A partire dalla seconda metà del 2026, le società finanziarie saranno tenute a fornire informative dettagliate sul loro utilizzo dell'IA e sulle strategie di mitigazione del rischio. Questa mossa si allinea con una tendenza globale più ampia di crescente controllo sull'intersezione tra artificial intelligence e stabilità finanziaria.

Sebbene ci impegniamo per l'accuratezza, bytevyte può commettere errori. Si consiglia agli utenti di verificare tutte le informazioni in modo indipendente. Non accettiamo alcuna responsabilità per errori o omissioni.

Related Articles

- I rischi per la sicurezza di Claude Mythos innescano il vertice federale sull'IA

- AWS svela Claude Mythos Cybersecurity e Agent Registry

- Anteprima Claude Mythos: Svolta nella Sicurezza o Hype dell'IA?

✔Human Verified