NVIDIA presenta Nemotron 3 Nano Omni per ottimizzare i flussi di lavoro AI multimodali

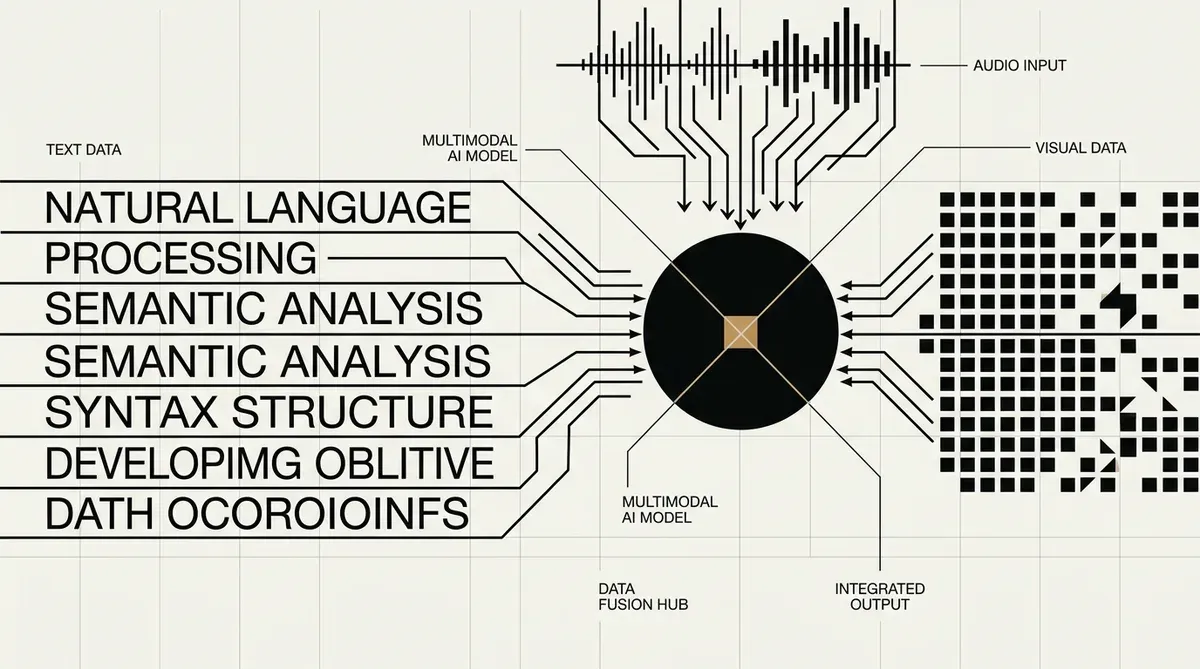

NVIDIA ha lanciato Nemotron 3 Nano Omni, un modello da 30 miliardi di parametri progettato per unificare l'elaborazione di testo, immagini, video e audio in un'unica architettura. Rilasciato questa settimana, il modello utilizza un design ibrido Mixture-of-Experts (MoE) che mantiene solo 3 miliardi di parametri attivi durante l'inferenza. Questo approccio consente a Nemotron 3 Nano Omni di offrire significativi incrementi prestazionali riducendo al contempo il sovraccarico computazionale tipicamente associato alla gestione di modelli separati per diversi input sensoriali.

L'architettura integra layer Mamba per gestire in modo efficiente i dati a sequenza lunga insieme ai layer Transformer standard per compiti di ragionamento complesso. Consolidando la comprensione visiva e audio, NVIDIA afferma che il sistema raggiunge un throughput fino a 9 volte superiore rispetto agli stack AI frammentati tradizionali. Il modello è specificamente ottimizzato per l'uso del computer di tipo agentico, consentendo agli assistenti AI di navigare nelle interfacce grafiche e analizzare documenti intricati con maggiore precisione.

Specifiche tecniche e prestazioni

Il Nemotron 3 Nano Omni presenta una massiccia finestra di contesto da 256K token, che gli consente di elaborare set di dati estesi o contenuti video di lunga durata. Per l'elaborazione video, il modello impiega la compressione Conv3D, mentre le attività audio sono gestite tramite il framework Parakeet-TDT. I benchmark di NVIDIA indicano che il modello è leader in categorie come MMlongbench-Doc e WorldSense, evidenziando la sua capacità nell'intelligenza documentale e nel ragionamento spaziale.

L'efficienza rimane un obiettivo centrale di questa release, con NVIDIA che riporta un miglioramento di 4 volte nell'efficienza di calcolo. Il modello richiede circa 25 GB di RAM per il funzionamento ed è disponibile in molteplici formati di precisione, tra cui BF16, FP8 e lo specializzato NVFP4. Queste ottimizzazioni assicurano che il Nemotron 3 Nano Omni possa essere distribuito su varie configurazioni hardware senza sacrificare la velocità richiesta per le applicazioni in tempo reale.

Implicazioni strategiche per l'AI aziendale

Per i CTO e gli strateghi tecnologici, il passaggio verso modelli multimodali unificati rappresenta un allontanamento dalla complessità di mantenere pipeline distinte per diversi tipi di dati. La capacità del Nemotron 3 Nano Omni di gestire input diversi all'interno di un unico framework riduce l'attrito di integrazione e abbassa il costo totale di proprietà per l'infrastruttura AI. Questo consolidamento è particolarmente rilevante per le aziende che sviluppano agenti autonomi che devono interagire con ambienti software progettati per utenti umani.

NVIDIA ha reso il modello accessibile tramite Hugging Face e i propri microservizi NIM, facilitando la distribuzione rapida per gli sviluppatori aziendali. Al 02-05-2026, il rilascio segna un passo significativo nella strategia di NVIDIA per fornire i layer software fondamentali necessari per la prossima generazione di agenti AI multimodali. Le organizzazioni che si concentrano sull'automazione dei documenti e sull'automazione basata su GUI potrebbero trovare in questa architettura unificata un componente critico nella loro roadmap tecnica.

Sebbene ci sforziamo per l'accuratezza, bytevyte può commettere errori. Si consiglia agli utenti di verificare tutte le informazioni in modo indipendente. Non accettiamo alcuna responsabilità per errori o omissioni.

Related Articles

- Amazon Bedrock integra OpenAI GPT OSS e NVIDIA Nemotron per diversificare le opzioni AI aziendali

- NVIDIA si aggiudica un contratto multimiliardario con il Pentagono per distribuire Nemotron AI su reti classificate

- NVIDIA lancia lo stack open-source NemoClaw per proteggere gli agenti AI autonomi

✔Human Verified